基礎知識

NVIDIA DGX SuperPODの概要と導入検討ポイント ― AIファクトリー時代のベストプラクティス

2026.04.13

GPUエンジニア

生成AIインフラに本格投資しようとする多くのチームが直面するのは「GPUを買えば終わりではない」という現実です。ネットワークやストレージ I/O、監視・障害対応、電源・冷却、ソフトの互換性まで含めて設計しないと、立ち上げ遅延や計画外コストにつながりがちです。

こうした課題に対する打ち手としてNVIDIAⓇが公開しているのが、NVIDIA DGX SuperPOD™です。これは、計算ノード(DGX Systems)に加えて、NVIDIA AI Enterprise(生成AI/AIエージェント開発を高速化するためのソフトウェアスタック)、ネットワーク、認定ストレージ、クラスタ運用管理までを検証済み構成として統合した、フルスタック型のAIクラスタ基盤です。統合・チューニングに伴う不確実性を抑えつつ、短期間で安定稼働へ移行しやすい点が特長です。

NTTPCは、DGX SuperPODをはじめとする大規模GPUクラスタの設計・構築・運用実績が評価され、NVIDIA Partner Networkパートナーに贈られる国内最高のアワード「Best NPN of the Year」を2年連続で受賞しました。

参考:NTTPCが「NVIDIA Partner Network Award 2026」において『Best NPN of the Year』を2年連続受賞 ~NTTPCエンジニア2名が特別賞として『Best Personal Award』を受賞~|プレスリリース|ニュースリリース|【公式】NTTPC

本記事では、DGX SuperPODの全体像とアーキテクチャ(NVIDIA AI Enterprise/Mission Controlなど)を整理したうえで、用途に応じたGPUサーバーの選定、ラックスケール構成、設置要件と運用設計、TCO観点の検討ポイントを、企業・研究機関向けに解説します。

【目次】

- NVIDIA DGX SuperPODとは?AIファクトリー時代のクラスタ基盤

- NVIDIA DGX SuperPODのアーキテクチャ

2-1. NVIDIA AI Enterprise:AIソフトウェアスタック

2-2. NVIDIA Mission Control:クラスタの運用・管理ソフトウェア

2-3. 基盤ハードウェア要素:計算ノード・ネットワーク・認定ストレージ - NVIDIA DGX SuperPODの導入メリット

3-1. 構成設計・性能チューニングの負担軽減

3-2. 将来の大規模化を前提とした設計

3-3. 検証済みのソフトウェアスタックでPoCから本番へ

3-4. 組織内の運用・セキュリティ設計も最適化済み

3-5. 外部専門家と進められる導入プロセス - DGX Systemsの選択肢:SuperPODをどの構成で組むか

4-1. 用途から見た選択の目安

4-2. 構成検討を進める際のポイント - NVIDIA DGX SuperPODの代表的なユースケース

5-1. 金融:リスク管理・不正検知・LLMによる業務自動化

5-2. 公共分野・行政向けAI基盤

5-3. 大学・研究機関の共用AIスーパーコンピューティング基盤 - まとめ

1. NVIDIA DGX SuperPODとは?AIファクトリー時代のクラスタ基盤

NVIDIA DGX SuperPODは、生成AI・大規模言語モデル(LLM)などの先端AI開発に最適化された、企業向けの大規模AIインフラストラクチャです。NVIDIAのDGXサーバーを中心に、計算ノード、ネットワーク構成、認定ストレージ、クラスタ管理ツール、運用管理ソフトウェアまでを、あらかじめ検証済みの構成で統合した、導入すればすぐに大規模AI計算を始められるターンキー型のAIクラスタ基盤として提供されます。

自社で一つ一つのコンポーネントを選定し、ハードウェア/ソフトウェアの調達・チューニング・性能検証を行う場合、構築に数カ月〜1年単位の時間がかかり、性能のばらつきや互換性が担保できないというリスクも無視できません。DGX SuperPODは、こうした導入までの不確実性を排除し、導入直後からAIワークロードを本格稼働できる「完成済みのAIクラスタ」として位置付けられています。

2. NVIDIA DGX SuperPODのアーキテクチャ

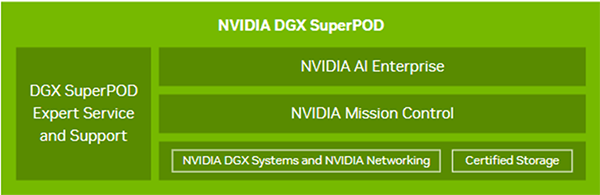

上記のように、NVIDIA DGX SuperPOD(DGX SuperPOD)は、AI開発から本番運用までに必要なすべての構成要素を一体化したフルスタック型のAIクラスタ基盤です。従来のように、個別に部品を選定・統合して構築するのではなく、NVIDIAによってあらかじめ検証された構成を“完成形”として導入できる点が最大の特徴であり、次の4つの主要な要素に分類されます。

- NVIDIA AI Enterprise:AI開発を高速化するソフトウェアスタック

- NVIDIA Mission Control™:クラスタ使用状況を可視化し、運用効率と障害予防を支援する運用・監視ダッシュボード

- 統合ハードウェア:計算ノード・ネットワーク・認定ストレージ

- White Glove Services:構築・導入・運用支援サービス

ここでは、DGX SuperPODを構成する4つの主要要素について、それぞれの役割と特徴の詳細を紹介します。

2-1. NVIDIA AI Enterprise:AIソフトウェアスタック

NVIDIA AI Enterpriseは、DGX SuperPOD上で動作するAI実行・開発ソフトウェアの標準スタックです。

LLMやRAG、エージェントAIといったユースケースに対応するための開発向けのフレームワーク(NVIDIA NeMo™など)、推論マイクロサービス(NVIDIA NIM™など)や、最適化済みライブラリ群などを統合しています。

NVIDIA AI Enterpriseを利用することで、動作環境(クラウド/オンプレミス)に依存せず同一のAI実行プラットフォームを用意することができます。これにより、次のような利点を創出しています。

- PoCから本番までのスタック断絶を解消

- ユースケースが変わっても同じ基盤で横展開が可能

- セキュリティレビュー済み・SLA対応の運用に接続しやすい

詳細は関連記事をご参照ください。

【関連記事】

NVIDIA AI Enterpriseとは?:導入のメリットからアーキテクチャとライセンス・運用設計のポイントまで解説

2-2. NVIDIA Mission Control:クラスタの運用・管理ソフトウェア

NVIDIA Mission Controlは、大規模AIクラスタを効率的に運用・管理するための統合管理ソフトウェアプラットフォームです。

従来のNVIDIA Base Command™の機能に加え、AIワークロードのオーケストレーション機能や高度な監視・自動復旧機能を包含した、DGX SuperPODの標準的な管理基盤です。

NVIDIA Mission Controlは、次のような機能を担っています。

- ジョブ管理(スケジューリング、優先度設定など)

- GPUリソースの可視化・割当管理

- ユーザー・プロジェクトごとのアクセス制御

- モニタリング(ログ、メトリクス、トレースなど)

- APIやGUIベースでのワークロード管理

2-3. 基盤ハードウェア要素:計算ノード・ネットワーク・認定ストレージ

NVIDIA DGX SuperPODを支える物理インフラは、主に次の3要素で構成されています。

- DGX Systems(計算ノード):AI処理専用に設計された高性能サーバー群で、大規模AIモデルの学習や推論を実行

- 高速ネットワーク(InfiniBand / Ethernet):NVIDIA Quantum InfiniBandやSpectrum™-X Ethernetなどを用い、複数のGPUサーバー同士を超高速で接続

- 認定ストレージ:AI学習用データやモデルを保存・供給するための高性能ストレージであり、NVIDIAによって性能検証済みのパートナー製品(DDN, NetApp, VAST Data, Pure Storageなど)を採用

これらの3要素が統合されることで、スケーラブルかつ一貫性のあるAI演算クラスタが完成します。

3. NVIDIA DGX SuperPODの導入メリット

NVIDIA DGX SuperPODは、構成要素単体の性能やスペックだけでなく、AI基盤をビジネスの軌道に乗せるまでの“導入・運用の壁”を取り除くという点で、他の構成方式とは異なる利点があります。ここでは、企業がSuperPODを導入することによって得られる実質的なメリットを5つの観点から整理します。

3-1. 構成設計・性能チューニングの負担軽減

従来、AIクラスタを自社構成する場合は、GPUノード/ネットワーク/ストレージ/ソフトウェアの組み合わせ検討、導入後の性能検証・再設計などに多大なリソースが必要でした。DGX SuperPODはこれらをNVIDIA検証済みのターンキー構成として提供するため、「動くかどうか」の心配なく、即座にAI活用に着手できます。

3-2. 将来の大規模化を前提とした設計

DGX SuperPODは、Scalable Unit(SU)単位での段階的増設を想定したスケーラブルな構成になっており、兆単位パラメータのLLM学習や大量並列推論などにも対応できます。PoC止まりにならず、初期導入を無駄にせず本番・横展開へ繋げられる拡張性が確保されています。

3-3. 検証済みのソフトウェアスタックでPoCから本番へ

NVIDIA AI Enterprise+Mission Controlにより、開発・学習・推論・運用までのソフトウェア基盤が最初から整備された状態で利用できます。これにより、大規模チームでもリソースを効率的に共同利用することができ、社内展開がスムーズになります。

3-4. 組織内の運用・セキュリティ設計も最適化済み

ログ、監査、アクセス制御、SLA/SLOといったエンタープライズ運用に必須な非機能要件にも対応しています。DGX SuperPODはNVIDIAが提供する事前検証済みの運用ガイドライン/セキュリティスキャン済みソフトを含むため、情報システム部門との連携や監査対応もスムーズです。

3-5. 外部専門家と進められる導入プロセス

設計〜構築〜最適化〜運用支援までをカバーするホワイトグローブサービスが標準で提供され、導入元が自力ですべて計画・検証する必要がありません。AI基盤の内製化に着手したいが、経験が不足している企業にとってもリスクを抑えて導入できる安心材料になります。

4. DGX Systemsの選択肢:SuperPODをどの構成で組むか

NVIDIA DGX SuperPODは、計算ノードである DGX Systems を中心に、ネットワーク、認定ストレージ、管理ソフトなどを含むフルスタックのAIクラスタ基盤です。

導入にあたっては、まず「どのようなAI活用を主軸とするか」を明確にしたうえで、それに最適なDGXモデル構成を選ぶことで、SuperPOD全体のバランスと将来拡張性を最適化することができます。

4-1. 用途から見た選択の目安

用途別に見ると、選択の目安は次のとおりです。

同じSuperPODでも、ワークロードによって“計算基盤の方向性”が変わります。

| 主な用途 | 選択候補 | 向いている理由 |

|---|---|---|

| エージェント型AI・次世代推論重視 | DGX Rubin NVL8 / DGX Vera Rubin NVL72 | エージェント型AIや高密度推論ワークロードを意識した設計 |

| 超大規模モデルの学習と推論 | DGX GB200 / DGX GB300 | 基盤モデルの超大規模トレーニングと大規模推論を想定した構成(ラックスケール設計) |

| 生成AI・LLMの汎用基盤 | DGX B200 / DGX B300 / DGX H200 | LLMや生成AIの学習・推論に幅広く対応する構成 |

※DGX Rubin NVL8/DGX Vera Rubin NVL72は、2026年以降に提供予定の新世代DGX Systemsです。執筆時点では出荷前のロードマップ段階のため、提供開始時期や詳細仕様は変更される可能性があります。最新情報はNVIDIA公式サイトをご確認ください。

実際の構成は、まず対象となるAIモデルの規模や、学習と推論の比重を踏まえて検討します。さらに、想定される同時利用数(ジョブ数やユーザー数)、データの入出力要件(データ量やストレージ帯域)、および拡張方針(複数ラックを束ねるクラスタ構成へのスケール)といった要素も加味しながら設計を進めます。加えて、設置を想定するデータセンター側の制約(具体的には、電源容量、空冷または液冷といった冷却方式、ラックスペース、ネットワーク接続、運用体制など)も確認し、こうした要件と制約の両面を満たす構成を最終的に決定していくと良いでしょう。

4-2. 構成検討を進める際のポイント

前段で整理したような要件やデータセンター側の制約は、一度構成を固めてしまうと後から大きく変更しにくい前提条件になります。そのため、見積もりや機器調達に進む前の段階で前提条件を関係者間で共有し、GPU世代・ノード数・ネットワーク/ストレージ構成の選択肢を一緒に検討しておくことが重要です。

NTTPCは、DGX SuperPODをはじめとする大規模GPUクラスタの設計・構築・運用実績が評価され、NVIDIA Partner Networkパートナーに贈られる国内最高のアワード「Best NPN of the Year」を2年連続で受賞しました(NTTPCが「NVIDIA Partner Network Award 2026」において『Best NPN of the Year』を2年連続受賞 ~NTTPCエンジニア2名が特別賞として『Best Personal Award』を受賞~|プレスリリース|ニュースリリース|【公式】NTTPC)。こうした知見を踏まえ、DGX SuperPOD/DGX Systemsの導入方針や構成案について検討中のお客さまの要件整理や構成検討にも対応しています。お気軽にご相談ください。

5. NVIDIA DGX SuperPODの代表的なユースケース

ここまで紹介してきたように、DGX SuperPODは「何で構成するか」だけでなく、どのように設計し、どう活用するかまでを見据えた統合型のAIインフラです。その柔軟な構成力と運用性により、導入先は単一の研究機関や開発部門にとどまらず、さまざまな業界・組織全体でのAI活用に広がりを見せています。

例えば、次のような領域で導入され、組織横断的なAIファクトリーとして活用されています。下記事例は、NTTPCが関わっていないケースも含みます。

5-1. 金融:リスク管理・不正検知・LLMによる業務自動化

グローバル金融機関であるBNY Mellonは、NVIDIA DGX SuperPODとNVIDIA AI Enterpriseを基盤としたエンタープライズAIプラットフォーム「Eliza」を構築し、1万7,000人以上のユーザーが日々の業務で活用しています。

Eliza上では40以上のAIアプリケーションが稼働しており、決済やリスク管理、クライアント対応などの業務において、責任あるAIに重点を置きながらグローバルな金融サービス全体のイノベーションを推進しています。

参考:BNY First Global Bank to Deploy AI Supercomputer Powered by NVIDIA DGX SuperPOD With DGX H100

5-2. 公共分野・行政向けAI基盤

米国の非営利組織であるMITREは、NVIDIA DGX SuperPODを搭載した「Federal AI Sandbox(連邦政府AIサンドボックス)」を構築し、政府機関全体でのAI利活用を支える共通基盤として運用しています。

このSandboxにより、各機関の担当者が共通の環境でモデルを検証できるようになり、気象予測、サイバーセキュリティ、行政サービスの高度化など、公共の利益に直結する分野でAIの可能性を迅速に検証・展開できるようになっています。

参考:AI for the Public Good:MITRE's Federal AI Sandboc with NVIDIA DGX SuperPOD

5-3. 大学・研究機関の共用AIスーパーコンピューティング基盤

フロリダ大学では、Blackwellアーキテクチャを採用したNVIDIA DGX SuperPODを中核とする「HiPerGatorAI」クラスタを整備し、大学の研究プロジェクトの60%以上を支える共用AI基盤として運用しています。

GatorTron医療分析ツールを含むこの強力なシステムは、直近1年間で7,000人近いユーザーに利用され、3,300万件以上の研究リクエストを処理するなど、医療・科学計算・データサイエンスなど幅広い分野の研究を支えています。

参考:Bringing AI Education to Every College and Discipline

6. まとめ

本記事では、NVIDIA DGX SuperPODの基本的な位置づけから、アーキテクチャ、導入メリット、DGX Systemsの選択肢、代表的なユースケースまでを整理しました。

NVIDIA DGX SuperPODは、GPUサーバーを並べるだけの環境ではなく、計算・ネットワーク・ストレージ・管理ソフトを含めて設計された大規模AI基盤です。生成AIや基盤モデルの学習・推論を、安定して継続運用することを想定した構成になっています。どのサーバーを選ぶか、どの規模で構築するかは、想定する用途と将来の拡張計画によって変わります。目的と運用計画を明確にしたうえで構成を選ぶことが、導入効果を高めるポイントとなるでしょう。

NTTPCでは、NVIDIA認定エリートパートナーとして、DGX SuperPOD/DGX Systemsの構成検討から、ネットワーク・ストレージ設計、設置環境(電源・冷却)を含む基盤構築まで支援しています。お気軽にご相談ください。

▶︎ お問い合わせはこちら

※「NVIDIA」「DGX」「DGX SuperPOD」「 NVIDIA NeMo」「NVIDIA NIM」「DGX Systems」「NVIDIA Quantum」「NVIDIA Spectrum-X」「NVIDIA Rubin」は、米国およびその他の国におけるNVIDIA Corporationの商標または登録商標です。

※「InfiniBand」は、InfiniBand(R) Trade Associationの商標です。

※「DDN」は、DataDirect Networks, Inc.の商標または登録商標です。

※「NetApp」は、NetApp, Inc. の商標または登録商標です。

※「VAST Data」は、VAST Data Inc.の商標または登録商標です。

※「Pure Storage」はPure Storage, Inc.の商標または登録商標です。