基礎知識

GPUで進化するロボティクス──フィジカルAIと仮想訓練がもたらす技術革新

2025.11.17

GPUエンジニア

人手不足の解消やDX推進を背景に、ロボットの活用領域は工場の生産ラインから、物流倉庫、さらにはサービス業の現場へと急速に拡大しています。しかし、従来の「教えられた動きを正確に繰り返す」ロボットでは、人や障害物が動的に変化する複雑な現実世界に柔軟に対応することは困難でした。

今、ロボットの世界で起きているのは、この限界を超えるためのパラダイムシフトです。求められているのは、周囲の状況を自ら「見て」「考えて」「動く」、真に自律的なロボット。その高度な頭脳を実現するために、膨大なセンサー情報を処理し、高度なAIをリアルタイムで実行する能力が不可欠となり、その心臓部としてGPUが中心的な役割を担っています。

本記事では、なぜ現代ロボティクスの進化にGPUが不可欠なのか、その技術的背景から、最先端の開発手法である「フィジカルAI」、そして具体的な活用事例まで、わかりやすく解説します。

目次:

- ロボティクスとは?その進化の背景

1-1. 現代のロボティクスに不可欠なフィジカルAI - ロボティクスに求められる処理

- GPUが加速するロボティクスの性能

3-1. 認識(Perception)

3-2. 判断と制御(Decision) - ロボティクスに向くGPUの選び方

4-1. ロボティクス開発のフェーズ

4-2. 開発フェーズによる選定GPUの違い

4-3. 開発・トレーニングフェーズで必要なGPU

4-4. 推論・実行フェーズで必要なGPU - Sim-to-Real開発とは?ロボティクスの標準開発手法

5-1. Sim-to-Realによる高速学習サイクル

5-2. NVIDIAによるSim-to-Real開発 - 業界別に見るロボティクス×GPU活用の実例

6-1. 製造業(Manufacturing)

6-2. 医療(Healthcare)

6-3. ホームアシスタント(Home Assistants)

6-4. カスタマーサービス(Customer Service)

6-5. 工場や倉庫(Factories & Warehouses) - まとめ:GPUが切り拓くロボティクスの未来

1. ロボティクスとは?その進化の背景

ロボティクスとは、センサーやAIを活用して、ロボットが自律的に動作する技術分野です。従来の産業用ロボットは、決められた動作を高速かつ高精度に繰り返すことに特化しており、主に工場内の固定された環境で使用されてきました。

しかし近年では、物流倉庫や自動運転など、変化の多い現実空間での活用が進んでいます。こうした環境では、人やモノが常に動いており、ロボットには状況を認識し、その場で判断して動作する「自律制御」 が求められます。

1-1. 現代のロボティクスに不可欠なフィジカルAI

このような現実世界で自律的に動くAIのことを「フィジカルAI」と呼びます。従来のAIは、テキストや画像を生成するなど、PC画面内で完結する処理が中心でした。一方でフィジカルAIは、カメラやセンサーを通じて周囲の状況を把握し、AIがその情報をもとに判断し、モーターやアクチュエーターを動かして物理的な行動を取ることができます。

フィジカルAIは、次世代のロボティクスを実現するための中核技術として、製造・物流・交通・建設など多くの産業分野で注目されています。

2. ロボティクスに求められる処理

ロボティクスにおけるフィジカルAIは、「現実世界で見て、考えて、動く」自律的な行動をリアルタイムで実現する必要があります。

このようなロボット制御には、以下のような3つの高度な処理が不可欠です。

【ロボティクスに必要な処理例】

- 認識:センサー情報の並列・高速処理

カメラやレーザーを用いて周りの環境を把握できるLiDAR(レーザーセンサー)、加速度装置やジャイロセンサーを利用して姿勢制御に使われるIMU(慣性計測装置)などのセンサーから得られる膨大なデータをリアルタイムで統合し、空間や物体、人物を高精度に認識する処理。 - 判断:AIモデルによる意思決定処理

認識した情報をもとに、ディープラーニングモデル(例:経路計画、障害物回避モデルなど)を用いて、最適な行動を瞬時に選択。 - 制御:即時性と安定性が求められる出力処理

AIによる判断結果に基づいて、ロボットのアクチュエーターを正確かつ遅延なく制御する処理。

こうした一連の認識 → 判断 → 制御は、すべてリアルタイムで途切れることなく処理される必要があります。しかも、センサーは常時稼働し、外部環境も刻一刻と変化します。この膨大かつ高負荷な計算を高速にこなすために不可欠なのが、GPU(グラフィックス処理ユニット)です。

3. GPUが加速するロボティクスの性能

ロボットが人間のように「見て、考えて、動く」ためには、大量のデータを瞬時に処理できるコンピューティング性能が求められます。その中心的役割を担うGPUは、もともとゲームや映像処理などのグラフィックス描画用に開発されました。しかし現在では、AI処理やロボティクス制御の基盤技術としても活用されています。GPUは、多数の演算処理を同時に並列で実行できるため、ロボットが現実世界をリアルタイムで認識・判断・制御する際の高速処理を支えています。

ここでは、ロボティクスにおける3つの主要な処理ステップ(認識・判断・制御)において、GPUがどのように活用されているかを見ていきましょう。

3-1. 認識(Perception)

「自分は今どこにいて、周りに何があるのか?」を把握するステップです。

現代のロボットには、カメラやLiDAR(レーザーセンサー)など多様なセンサーが搭載されています。これらから得られるデータは非常に膨大かつ複雑で、人間の目のようにリアルタイムで状況を把握するには、高速かつ並列な処理が欠かせません。

以下は、「認識」を行うための代表的な技術です。

- カメラ・LiDAR(レーザーセンサー)によるセンサーフュージョン:

複数のカメラやLiDAR(レーザーセンサー)から集めた情報を合成して、3Dの地図をその場で作ります。 - SLAM(自己位置推測と地図作成の同時実行)による自己位置推定と環境マッピング:

周囲の環境地図を作成しながら、その地図上のどこに自分がいるのかを把握します。 - ディープラーニングによる物体検出と分類:

カメラ映像から「これは人」「これは箱」といった判断を、AIでリアルタイムに行います。

こうした処理は、いずれもリアルタイム性が求められるため、GPUのような並列処理に優れた計算資源が不可欠です。

3-2. 判断と制御(Decision)

この段階では、AIがセンサー情報や地図データをもとに状況を分析し、最適な行動を選択(判断)し、その行動を正確に実行(制御)します。たとえば、「目の前に人がいるので停止すべきか?」「障害物を避けるにはどのルートを通るか?」といった意思決定を、1秒間に何十回も繰り返し、しかも遅延なく反応する必要があります。

以下は、「判断」と「制御」を行うための代表的な技術です。

- 強化学習による動作生成:

試行錯誤を通じて最適な行動方針(ポリシー)を学習するAI技術です。ロボットが環境との相互作用を重ねる中で、「どのような行動をとれば望ましい結果が得られるか」を自律的に学びます。 - 経路計画とナビゲーション:

地図と現在地、目的地に基づいて、障害物を避けながら最適なルートを計算する技術です。 - 周囲の変化へのリアルタイム反応:

ロボットがセンサー情報を継続的に取得しながら、急な障害物の出現や環境変化に対してミリ秒単位で反応し、安全に動作するための制御技術です。

こうした処理には、膨大な演算処理が必要です。GPUは、並列処理に優れた演算を得意としているので、複雑なAIモデルの実行をリアルタイムで行うことができます。

4. ロボティクスに向くGPUの選び方

ロボティクス開発では、目的の異なる2種類のGPUが使い分けられます。それぞれの役割を理解し、適切に選定することが重要です。

4-1. ロボティクス開発のフェーズ

ロボット開発は、大きく分けると2つのフェーズに分けることが可能です。

- 開発・トレーニングフェーズ:AIを学習する

開発者は、超高性能GPUを使って、AIに大量のデータを学習させます。 - 推論・実行フェーズ:現場(Edge側)でAIを動かす

学習済みAIモデルを、小型のエッジデバイスにそのままインストール(デプロイ)し、実際に推論・動作させます。

4-2. 開発フェーズによる選定GPUの違い

この2つのフェーズでは、必要とされるGPUの要件が大きく異なります。

以下にその概要をまとめました。

| 開発・トレーニングフェーズ | 推論・実行フェーズ | |

|---|---|---|

| 主なGPU製品 | 開発用GPU:NVIDIA DGXシリーズ, データセンターGPU等 | 組み込み用GPU:NVIDIA Jetsonシリーズ等 |

| 必要な役割 | AIモデルの学習、大規模シミュレーション | 学習済みAIモデルの実行(推論) |

| 特徴 | 最高の計算性能、大容量メモリ | 小型、省電力、リアルタイム処理に特化 |

| 設置場所 | 開発室、データセンター | ロボット本体 |

このように、開発・トレーニングフェーズと推論・実行フェーズではそれぞれ異なる役割があります。

4-3. 開発・トレーニングフェーズで必要なGPU

AIに行動を覚えさせるには、膨大なデータと試行錯誤(例:100万回のピッキング学習など)が必要です。このプロセスには、高い演算能力と大容量メモリを備えたGPUが求められます。

例えば、NVIDIAのH100やH200、さらに最新のBlackwellアーキテクチャ(B100/B200)などが、開発速度を飛躍的に高める手段として活用されています。

関連記事:

▶︎ NVIDIA H200 GPUで加速する生成AI ~H100との比較から次世代B200シリーズまで徹底解説~

▶︎ 生成AIのパフォーマンスが大幅アップ!?NVIDIA BlackwellアーキテクチャGPUの性能

4-4. 推論・実行フェーズで必要なGPU

一方で、実際のロボットに搭載するGPUには、以下のような特性が求められます。

- 小型であること(省スペース設計)

- 低消費電力(バッテリー駆動に対応)

- リアルタイム応答(低遅延で動作)

こうした要件を満たすため、現場でAIを“動かす”フェーズでは、Jetsonのような組み込み向けGPUが活躍します。

Jetsonは、NVIDIAが提供する、小型の組み込み向けAIコンピュータシリーズの名称で、ロボット本体への搭載に最適です。

最終的にどのGPUを選ぶかは、開発する要件に合わせて総合的に判断することが大切です。GPU選定の方法は次の関連記事もご覧ください。

関連記事:データセンターGPU性能比較:指標別に見る製品の選定ポイント

5. Sim-to-Real開発とは?ロボティクスの標準開発手法

GPUはロボットの知覚や判断、制御を支える重要な計算基盤ですが、実機を用いた試行錯誤だけでは、安全性や開発効率に限界があります。

そこで注目されているのが、「Sim-to-Real(シム・トゥ・リアル)」という開発手法です。ここでは、現代のロボティクス開発において標準となりつつあるこの手法について紹介します。

5-1. Sim-to-Realによる高速学習サイクル

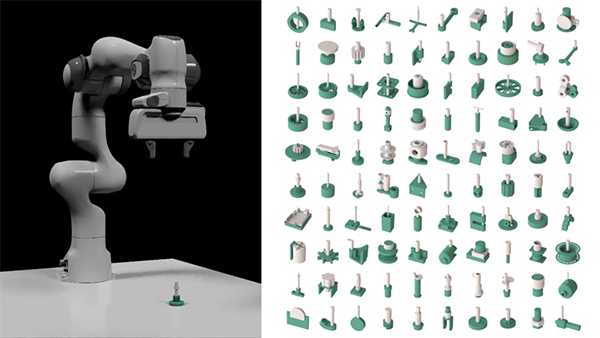

Sim-to-Real(シム・トゥ・リアル)とは、ロボット開発におけるトレーニング工程を効率化する手法で、仮想環境(シミュレーション)でAIを学習させたのちに、現実世界で応用するという考え方です。

現実のロボットにいきなり学習を行わせる場合、次のような課題が伴います。

【現実環境での学習リスク】

- 安全性の問題:誤動作による衝突や損傷のリスク

- コストの増加:設備、人員、ロボット本体にかかるコスト

- 学習時間の長さ:実環境ではトライアンドエラーの繰り返しが非効率

こうした課題に対して、Sim-to-Realは次のようなメリットを提供します。

【Sim-to-Realのメリット】

- 高精度シミュレーションの実現:

シミュレーションツールを使えば、物体の質感や光の反射、重力や摩擦など現実と見分けがつかないほどの世界を作ることができます。 - 合成データ生成による学習効率と精度向上:

シミュレーションであれば、現実ではなかなか起きないレアな場面(事故や暗い場所など)も自由に作ってAIに学習させることができます(合成データ生成)。こうした合成データを活用することで、AIの頑健性(ロバスト性)が飛躍的に向上します。頑健性が向上するとは、AIが予期しない状況や環境の変化にも安定して対応できるようになることを意味します。特に、現実世界に直接作用するフィジカルAIやロボティクスの分野では、この「想定外への強さ」が、安全かつ信頼性の高い動作を支える重要な要素となります。 - コスト削減と安全性向上:

現実のロボットを使うと、壊れたりケガをしたりする危険があります。しかしシミュレーションであれば、何百万回でも安全に・速く・安く学習することが可能です。そのため開発にかかる時間とコストを大きく減らせるというメリットがあります。

そのためまず仮想空間(シミュレーション)でAIを訓練し、その後に現実で動かすというのがSim-to-Realの考え方です。

Sim-to-Realイメージ

(引用:「Training Sim-to-Real Transferable Robotic Assembly

Skills over Diverse Geometries」サムネイル画像より)

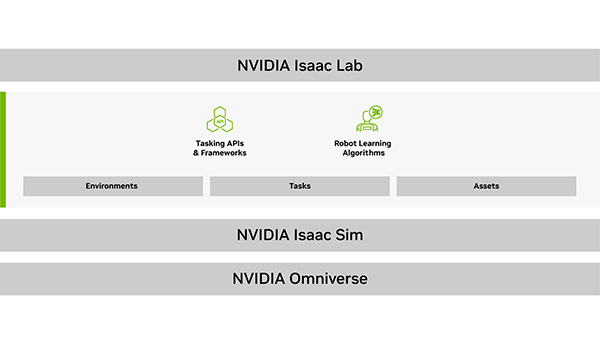

5-2. NVIDIAによるSim-to-Real開発

NVIDIAでSim to Realを実現するための環境は、次のとおりです。

- NVIDIA Isaac™ Lab

ロボットに搭載するAIを仮想空間内で学習・訓練するためのトレーニング環境です。仮想空間で何千回・何万回もの繰り返し学習を行うことができ、実際の環境で起こりうるさまざまなケースに対応したAIを育てることが可能です。 - NVIDIA Isaac™ Sim

NVIDIA Omniverse™上で動作するロボット専用のシミュレーションツールです。現実の環境を3D空間で再現し、ロボットがどのように動作するかを仮想的に検証することができます。 - NVIDIA Omniverse™

物理現象や光の反射まで忠実に再現できる高精度な仮想空間プラットフォームです。ロボットやAIの開発者は、この仮想環境を活用することで、現実世界に近い精度でシミュレーションや検証を行うことができます。

関連記事:NVIDIA Omniverse™徹底導入ガイド|建築・製造・エンタメ業界で広がる3D仮想空間

6. 業界別に見るロボティクス×GPU活用の実例

GPUの力によって、ロボットが自分で「見て・考えて・動く」ことができるようになり、さまざまな業界で実用レベルのAIロボットが活躍し始めています。

ここでは、代表的なユースケースを紹介します。

6-1. 製造業(Manufacturing)

工場の組立ラインでは、AIロボットが人と協働しながら次のような役割を果たすことが可能です。

- 部品の取り扱いや組立補助

- 繰り返し作業や肉体的に負担の大きい作業の代替

- 点検・メンテナンス業務

6-2. 医療(Healthcare)

医療分野では、サポートロボットが以下の業務を行うことで医療従事者の負担を軽減し、患者ケアの質を高めると期待されています。

- 患者のサポート

- 医療施設内での物品運搬や業務支援

- 将来的には医療処置の一部も担う可能性

6-3. ホームアシスタント(Home Assistants)

家庭内では、生活支援ロボットが以下の家事やコミュニケーションを担当することで、暮らしを快適にするのに役立ちます。

- 掃除・料理・洗濯などの家事

- 自然言語処理を使った会話や指示の理解

- 個人の生活習慣や好みに合わせて行動を調整

6-4. カスタマーサービス(Customer Service)

接客や案内の現場では、サービスロボットが人と以下のように直接人とやりとりすることで、サービスの質を向上できます。

- 店舗・空港・ホテルなどでの案内や情報提供

- 道案内や場所の誘導

- 基本的な問い合わせ対応

6-5. 工場や倉庫(Factories & Warehouses)

工場や倉庫では、シミュレーションを活用することで、次のように現場を事前に効率的で安全な状態に整えるでしょう。

- 作業レイアウトの最適化:仮想空間でライン配置を検証し、最も効率的な流れを決定

- 動線の改善:人とロボットがスムーズに移動できるルートを設計し、衝突を防止

- 設備トラブルの予防:故障や異常を事前に予測し、安定した稼働を維持

7. まとめ:GPUが切り拓くロボティクスの未来

本記事では、現代のロボティクスの解説とどのようにGPUの力でその進化が加速したかを解説しました。GPUは、ロボットが「見る(認識)」「考える(判断)」「動く(制御)」という一連の動きをこなすために欠かせない存在です。さらに、GPUのパワーを活かしたシミュレーション技術によって、仮想空間でAIを育て、現実世界で活躍させる「フィジカルAI」という新しい時代も始まっています。

こうした流れは、もはや研究室だけの話ではありません。工場、物流、医療、農業、小売など、さまざまな産業現場で、GPUによって進化した賢いロボットが実際に活躍し始めています。これからのロボティクスの進化を支える上で、GPUは生産性の向上や人手不足の解消に貢献する、なくてはならない技術になっていくでしょう。

ロボティクスやAIソリューションの導入を成功させるには、ワークロードの正確な分析、適切なハードウェアとソフトウェアの選定、そして信頼できるパートナーとの計画的な導入が不可欠です。

NTTPCは、ロボティクスの進化に欠かせないGPUインフラ環境の提供を通じて、変革にチャレンジする企業の取り組みを支援しています。ぜひお気軽にご相談ください。

▶︎ お問い合わせはこちら

※「NVIDIA」「NVIDIA Jetson」「NVIDIA Jetson Xavier™ NX」「NVIDIA Isaac™」「NVIDIA Omniverse™」は、NVIDIA Corporationの商標または登録商標です。