生成AIの実用化やLLM(大規模言語モデル)の業務利用が進んだことで、企業におけるGPUの位置づけは、研究用途の特殊な計算資源から、事業を支える基盤インフラへと変化しています。AI学習・推論、データ分析、3DCG処理など、GPUを前提としたワークロードは年々多様化・高度化しています。こうした状況の中、オンプレミス環境やデータセンターでGPUサーバーを運用するケースも増えており、GPUへの投資額は構成や導入規模によっては数億円規模に達することも珍しくありません。

一方で、メーカー公表の仕様値(VRAM、TFLOPS等)や汎用的なベンチマークスコアを“数値だけで単純比較”してGPUを選定した結果、想定した性能が出ない、あるいはコストに見合わない構成となってしまう例も見受けられます。

特に2026年現在では、従来の「演算性能(TFLOPS)中心」の見方だけでは不十分となり、電力や冷却といったインフラ要件も含めて、VRAM容量やメモリ帯域幅、アーキテクチャ世代など、実運用に直結する指標を踏まえた判断が求められています。

本記事では、GPUスペック表で押さえるべき5つの主要要素(VRAM容量、TFLOPS、メモリ帯域幅、TDP、アーキテクチャ世代)を整理したうえで、データセンターでの運用を想定したケースを中心に、AI学習・推論、3DCGレンダリング、データ分析といった用途別に、実務に即したGPU選定の考え方を解説します。

GPUスペック表で押さえるべき主要項目 ― 性能を決める5つの要素

GPUスペック表の見方とは、単に数値の大小を比較することではなく、用途に応じて各性能指標の意味と優先順位を正しく理解することにあります。GPU選定の際、メーカーのカタログや公式サイトには、VRAM容量、TFLOPS、メモリ帯域幅、TDPなど、多くの指標が並びます。一方で、指標の数が増えるほど比較は複雑になり、「どの数値を重視すべきか判断できない」と感じるケースも少なくありません。特に、生成AIやデータ分析など複数のワークロードを想定する場合、単一の指標だけで性能を評価することは困難です。

特に法人用途においては、ピーク性能の高さだけでなく、実際のワークロードとの適合性、運用時のコストや消費電力、将来的な拡張性まで含めた総合的な判断が求められます。そのため、GPUスペック表に記載されたすべての数値を同列に扱うのではなく、実務に直結する項目を整理して捉えることが重要です。

次に、GPUスペック表で特に重要となる主要項目を一覧としてまとめます。

| 項目 | 指標の意味 | 実務上の影響 |

|---|---|---|

| VRAM容量(メモリ) | 一度に載せられるモデル・データの規模 | LLMのパラメータ規模やバッチサイズに大きく影響 |

| 演算性能(TFLOPS) | 単位時間あたりに処理可能な演算量 | 学習・推論の「スループット/処理速度」の目安 |

| メモリ帯域幅 | メモリとGPUコア間のデータ転送速度 | 行列演算・Attentionなどメモリ負荷の高い処理に影響 |

| 消費電力(TDP) | 冷却設計上の想定最大熱設計値 | ラックあたりの収容数や電源・空調コストを見積もる際の指標 |

| アーキテクチャ世代 | GPUコアの設計世代・対応機能 | 同じTFLOPS値でも対応精度や電力効率など実効性能が大きく変化 |

これらの指標は、それぞれがGPUの異なる側面を表しており、どの項目を重視すべきかは用途によって異なります。次にそれぞれの項目の詳細をみていきましょう。

VRAM容量(メモリ)― モデル規模と処理の上限を左右する指標

VRAM容量とは、GPU上にどの程度のモデルやデータを同時に展開できるかを示す基本的な指標です。

GPUの演算性能が十分でも、VRAM容量が不足すると、モデルをロードできない場合や入力長*1・バッチサイズ*2に制約が出る場合があります。

特に、LLMの推論・学習や高解像度の画像・動画処理では、必要なVRAM容量を下回ることで、

「モデルをロードできない」

「入力長やバッチサイズを小さくせざるを得ない」

といった制約が顕在化しやすくなります。これらは処理性能だけでなく、モデル品質や運用効率にも影響を及ぼします。

また、同じGPUであっても、「単一のGPUで処理を完結させるのか」「マルチGPUで分散させるのか」によって、必要となるVRAM容量は変わります。そのため、実務ではPoC段階ではやや控えめなVRAM構成で検証を行い、本番設計では将来的な拡張や運用余地を見据えて余裕を持った構成へ見直す、といった段階的な進め方が有効です。これにより、投資負担と性能不足リスクのバランスを取りやすくなるでしょう。

- 使用するモデルのサイズ(パラメータ数、量子化の有無)

- 入力長(トークン長)やバッチサイズ

- 画像・動画処理の場合は、解像度、フレーム数、色深度

*1:モデルに読み込ませるプロンプト(ユーザーがモデルに対して送る指示)の長さ。これが長くなると必要VRAMが増加する。

*2:1度にまとめて読み込ませるデータ量。VRAMによって読み込ませられるデータ量の上限が決まる。

演算性能(TFLOPS) ― 計算速度の目安となる指標

GPUの仕様には、「FP32 TFLOPS」「FP16 Tensor TFLOPS」「INT8 Tensor TOPS」など、複数の演算精度ごとの性能値が記載されるのが一般的です。FP32、FP16、FP8といった表記は、浮動小数点の精度(1つの数値を表す情報量)の違いを示します。

一般にFPの数値が小さいほど情報量が減るため精度は落ちますが、その分データ量や計算が軽くなり、対応する演算ユニット(例:Tensor演算)を使う前提では処理が高速になりやすくなります。

そのため、これらは同じTFLOPS表記であっても、前提となる演算精度が異なるため、そのまま単純比較することはできません。

AI用途で主に利用される演算精度は、次のとおりです。

- FP32

従来から使われてきた標準的な精度で、古いモデルや一部の学習処理で利用されます。 - FP16 / BF16

現在のAI学習で主流となっている精度です。最新世代のGPUでは、この領域で高い演算性能を発揮します。 - INT8 / FP8

推論でよく使われる低精度演算で、環境やワークロードによっては学習側でも利用されます。

GPUスペックを比較する際は、最大値だけを見るのではなく、自社の用途に近い演算精度の性能値を基準に確認することが重要です。

メモリ帯域幅 ― データ転送のボトルネックを左右する指標

メモリ帯域幅とは、GPUコアがメモリとの間でどれだけ効率よくデータを読み書きできるかを示す指標です。演算性能やVRAM容量が十分であっても、メモリ帯域幅が不足している場合、GPUは必要なデータを待つ時間が増え、処理全体の性能が頭打ちになることがあります。特に、行列演算やAttention処理*3のようにメモリアクセスが頻繁に発生するワークロードでは、計算そのものよりもデータ転送がボトルネックとなりやすく、GPUの性能を十分に引き出せないケースが少なくありません。

近年のGPUでは、アーキテクチャやメモリ技術の進化により、このメモリ帯域幅が大きく強化されてきました。

その結果、同じVRAM容量であっても、帯域幅の広い構成ほどデータ転送の待ち時間が短縮され、学習や推論におけるスループットの向上が期待できるようになってきています。

*3:文章(トークン列)の中で、あるトークンが「どのトークンをどれくらい参照すべきか」を計算し、その結果を使って情報を“重み付きで混ぜる”処理です。

消費電力(TDP) ― 運用コストとインフラ要件の指標

TDP(Thermal Design Power)は、冷却および電源設計の目安となる想定最大熱設計電力を示す値です。GPUサーバーをラック単位で導入する場合、ノードごとのTDP合計は、必要な電源容量や空調負荷を見積もる際の目安になります。

特に複数GPUを搭載する構成では、GPU単体のTDPが積み重なることで、ラックあたりの搭載台数や冷却方式(空冷・液冷)の選択に影響します。

例えば、高性能GPUを8枚搭載したサーバーと、省電力GPUを多数搭載したサーバーとでは、求められる電源・冷却設計が大きく異なります。

そのため、GPU選定ではハードウェア本体の価格だけでなく、ラックあたりの収容効率や電力・空調コストまで含めて検討することが重要です。

特にデータセンターを利用する場合、ラックあたりの電力上限や発熱制約により、実質的に選択可能なGPUクラスが制限されることもあります。

アーキテクチャ世代 ― 同じスペックでも世代で実効性能は変わる

GPUのアーキテクチャ世代とは、GPUコアの設計思想や対応機能の世代を指します。

同じようなスペック表記であっても、世代の違いによって、実際の性能や効率は変わりやすくなります。

NVIDIAのGPUは、用途別に次のような世代進化を辿ってきました。

- データセンター向け:Ampere → Hopper → Blackwell

- グラフィックス/プロフェッショナル向け:Ampere → Ada Lovelace → Blackwell

世代が新しくなるにつれて、単純な演算性能の向上だけでなく、次のような改善が段階的に行われています。

- Tensorコアの強化

対応する演算精度の拡張、AI向けスループットの向上。 - メモリ技術の刷新

HBM2e→HBM3→HBM3eへの進化、メモリ帯域幅の拡張。 - 電力効率の向上

同等、あるいはそれ以上の性能の低消費電力化。 - AI特化機能の追加

Transformer Engineの強化、FP8/FP4など低精度演算への対応拡大。

たとえばTransformer系の推論・学習では、行列演算そのもの以外に、メモリアクセスやデータ整形、Attentionの計算などが混ざるため、ピークTFLOPSが高くてもTensorコアを常に使い切れるとは限りません。Hopper/Blackwell世代ではTransformer Engineや各種最適化により、こうした処理でTensorコアの利用率を高めやすい設計になっているため、同じ「理論性能」に見えても実効性能に差が出ることがあります。

GPUスペック表を確認する際は、個々の数値だけで判断するのではなく、どのアーキテクチャ世代のGPUか、そして想定ワークロードが計算律速*4か(TFLOPSが効くか)・メモリ/通信律速*5かもあわせて確認しておくことで、選定時の判断ミスを避けやすくなります。

*4計算律速:処理性能がGPUの演算能力によって制限されている状態を指します。 この場合、演算器(CUDA Core や Tensor Core)が高い稼働率で動作しており、 FP16/FP32 などの TFLOPS が性能に直結しやすい特性があります。

*5通信律速:処理性能がGPU間やノード間のデータ通信によって制限されている状態を指します。 計算自体は完了していても、勾配同期や中間データの受け渡し待ちが発生するため、 単体GPUの演算性能(TFLOPS)を高めても全体性能は向上しにくくなります。

GPU製品・サービス

AI / IoT、デジタルツイン用途に適したGPUサーバーを設計・構築。さらにデータセンター・ネットワークなど、GPU運用に必要なシステムをワンストップで提供可能。

【関連記事】

・GPU選定の失敗を防ぐ!ベンチマークで真の性能を見極める方法と注意点

用途別のGPUスペック重視ポイントとは? ― AI・レンダリング・データ分析

GPUの「適切さ」は一律ではなく、用途によって重視すべきスペックが異なります。GPUは汎用的な計算装置ですが、AI学習、推論、3DCGレンダリング、データ分析・シミュレーションなど、用途ごとに負荷のかかり方は大きく異なります。

その結果、同じGPUであっても、用途によっては性能を持て余したり、逆に特定の要素がボトルネックとなることがあります。

そこで、本章では用途別にどのスペックを優先して見るべきかを整理します。まずは、代表的なデータセンター向けGPUを俯瞰し、用途ごとの位置づけを確認していきましょう。

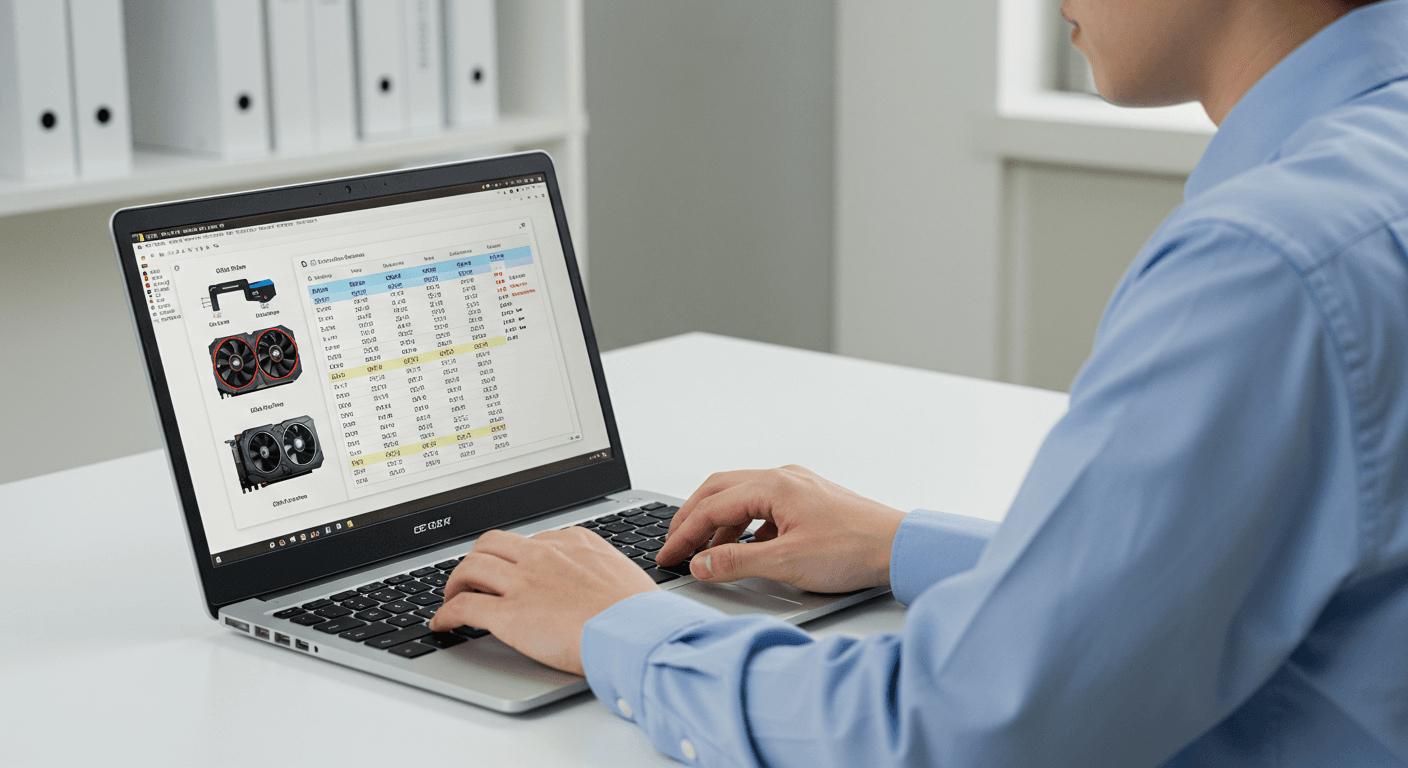

代表的なデータセンター向けGPUのスペックと主な用途イメージ

ここでは、代表的なNVIDIAのデータセンター向けGPUに加えて、データセンター環境でも利用されるプロフェッショナル向けGPUについて、用途イメージと主要スペックを簡潔に比較します。

なお、詳細な数値はベンダーやシステム構成によって変動するため、あくまで「傾向を把握するための一覧」としてご参照ください。

| 製品・構成 | アーキテクチャ | メモリ構成の一例 | 主な用途イメージ |

|---|---|---|---|

| B200 | Blackwell | 180GB HBM3e / 7.7TB/s | LLM学習・推論、HPC/解析 |

| H200 | Hopper | 141GB HBM3e / 4.8TB/s(SXM) 141GB HBM3e / 4.8TB/s(NVL) |

大規模LLM学習・推論 |

| H100 | Hopper | 80GB HBM3 / 3.35TB/s(SXM) 94GB HBM3 / 3.9TB/s(NVL) |

汎用AI学習・推論 |

| L40S | Ada Lovelace | 48GB GDDR6 / 864GB/s | 生成AI・3DCGレンダリング・推論 |

| L4 | Ada Lovelace | 24GB GDDR6 / 300GB/s | 省電力推論・動画処理・アクセラレータ |

| RTX PRO 6000 (Workstation Edition) | Blackwell | 96GB GDDR7 / 1,792GB/s | 生成AI・推論、3D/映像(WS系) |

| NVIDIA RTX 6000 Ada | Ada Lovelace | 48GB GDDR6 / 960GB/s | 生成AI・推論、3D/映像(WS系) |

このように、GPUごとに想定されている用途や強みは異なります。

これらのGPUがどの用途で、どのスペックを重視して選ばれているのかを、用途別に詳しく見ていきます。

AI学習(トレーニング):演算性能とメモリ帯域幅を最優先

AI学習では、大規模なモデルと大量のデータを、繰り返しGPU上で学習させます。このため、VRAM容量に加えて、TFLOPSやメモリ帯域幅が性能を左右する主要な要素となります。

特に、LLMの学習では、演算性能が高くても、メモリ帯域が不足しているとスループットが伸びにくくなります。

目安としては、次のようなイメージで整理できます。

- 大規模LLMの学習:H100/H200、B200などHBM搭載・高帯域幅GPUが主流

- 中規模モデルやファインチューニング:A100世代やAda/Hopperの中位クラスでも対応可能

- マルチGPU構成:NVLink*6や高速ネットワーク(InfiniBandなど)の有無も要確認

*6:複数GPUで学習・推論するときに発生するGPU間通信を速くする仕組みです。GPU間のやり取りが多い処理ほど効果が出ます。

特に、LLMの事前学習レベルのワークロードでは、B200 / H200 / H100 のようなHBM搭載GPUが前提となるケースが多い一方で、自社モデルの継続的なファインチューニングやドメイン特化モデルの学習では、L40SやRTX PRO 6000といったGPUを複数枚組み合わせる構成でも、コストと性能のバランスが取りやすくなります。

また、学習ジョブのスループットを重視する場合は、GPU単体のスペックだけを見るのは不十分です。

ノード内のGPU接続方式や、クラスタ全体のネットワーク帯域を含めたスケール設計まであわせて検討することで、実効性能を引き出しやすくなります。

AI推論(インファレンス):VRAM容量と電力効率のバランスが重要

AI推論では、学習とは異なり、1リクエストをどれだけ低レイテンシで処理できるか、また単位時間あたりにどれだけ多くのリクエストを処理できるかが重要な指標となります。

特に、推論用途では、モデルをVRAM上に常駐させたうえで、同時リクエストを効率よく処理できる構成が求められます。そのため、単純な演算性能よりも、どれだけ安定して回せるかが設計上のポイントになります。

代表的な設計方針としては、次のような考え方があります。

- 省電力GPUを多数並べてスループットを確保する構成

L4のような低消費電力GPUを複数台搭載し、軽量なモデルの推論や動画処理をスケールアウトで処理する構成です。 - HBM搭載GPUで高負荷な推論に対応する構成

H100/H200/B200などを中核に据え、大規模LLMや高負荷なマルチモーダル推論でメモリ容量・帯域を確保するといった構成です。 - 量子化やバッチングによる効率化

GPUの種類に関わらず、許容できる精度・レイテンシの範囲で量子化やバッチングを取り入れ、同時処理数を増やすといった構成です。

推論基盤の設計では、ピーク時間帯の負荷やリクエスト数を踏まえ、1リクエストあたりのコストを意識しながらGPU構成を検討することが重要です。

その結果として、L4などを多数並べて軽量モデルを広く処理する構成にするか、H100/H200/B200などを中核に据えて高負荷推論を集約する構成にするか、あるいは量子化やバッチングで処理効率を高めるか、といった軸で判断しやすくなります。

3DCGレンダリング・映像制作:VRAM容量とレイトレーシング性能

3DCGレンダリングや映像制作では、高解像度テクスチャや複雑なシーンデータを扱います。そのため、VRAM容量が不足すると、シーン全体をGPU上に展開できず、処理効率が大きく低下します。

特に、Ada Lovelace 世代の L40S や RTX 6000 Ada、Blackwell 世代の RTX PRO 6000 は、RTコアやTensorコアを活用したハイブリッドレンダリングに強みがあり、生成AIによる素材生成と従来型レンダリングを組み合わせるようなワークフローにも適しています。

オフラインレンダリングが中心の場合は、データセンター向けGPUに限らず、こうしたプロフェッショナル向けGPUも含めて比較することで、ワークステーションとレンダーファームの役割分担を含めた検討がしやすくなります。

データ分析・シミュレーション:倍精度演算性能とメモリ容量

数値シミュレーションや一部のHPCワークロードでは、演算性能が重要な評価指標となります。これは、計算結果の精度がそのまま解析結果の信頼性に影響するためです。

このような用途では、AI推論向けに最適化されたGPUよりも、HPC向けに設計されたGPUの方が適しているケースが多くなります。

特に、倍精度演算性能やメモリ帯域を重視した設計のGPUは、数値計算系のワークロードで安定した性能を発揮します。また、大規模な行列計算やグラフ処理を行う場合には、GPUメモリ容量も重要な検討要素です。

単一のGPUでの処理を完結させるのか、複数GPUに分散させるのかによって、必要となるVRAM容量やメモリ帯域の要件は変わります。

このように要件を整理したうえでGPUを検討することで、過不足のない構成選定が可能になります。

また、NTTPCの見積もりシミュレーターでは、用途別の推奨構成と費用感を簡単にシミュレーションできます。GPUサーバー導入検討の参考としてご活用ください。

▶︎GPUサーバー見積シミュレーター

まとめ

GPUスペック表には多くの数値が並びますが、実務上は「VRAM容量」「演算性能(TFLOPS)」「メモリ帯域幅」「消費電力(TDP)」「アーキテクチャ世代」の5項目を押さえておくことで、用途に応じた選定が行いやすくなります。

特にAI学習・推論向けにGPUを選定する場合は、モデル規模や必要な演算精度、運用時の電力・インフラ条件を整理したうえで、どの要素にリソースを配分するかを明確にすることが重要です。

NVIDIAのGPUアーキテクチャは、Ampere、Ada Lovelace、Hopper、Blackwell等と進化を続けており、世代が進むにつれてメモリ技術やAI向け機能が強化されています。そのため、自社のロードマップと照らし合わせながら、どの世代をベースラインとするか、いつ次世代へ移行するかを検討することで、中長期のGPU投資計画を立てやすくなるでしょう。

GPUスペック表の見方を理解したうえで、実際の導入にあたっては、自社のワークロードに最適な構成や運用設計の検討が必要です。NTTPCでは、用途に応じたGPU構成のご提案から、導入後の運用サポートまで幅広く支援しています。GPU導入をご検討の際は、ぜひご相談ください。

GPU製品・サービス

AI / IoT、デジタルツイン用途に適したGPUサーバーを設計・構築。さらにデータセンター・ネットワークなど、GPU運用に必要なシステムをワンストップで提供可能。

※NVIDIA、Ampere、Hopper、 Blackwell、Ada Lovelace、RTX、NVLinkは、米国およびその他の国におけるNVIDIA Corporationの商標または登録商標です。

※InfiniBandは、InfiniBand(R) Trade Associationの商標です。