企業の業務システムにAIを組み込む場面では、必ずしも高性能なLLM(Large Language Models:大規模言語モデル)が最適とは限りません。問い合わせ対応や社内業務支援、制御・判定処理など、即時性や安定した応答が求められる用途では、モデルの性能よりも「軽さ」「速さ」「配置場所の自由度」が重要になります。こうした要件に適しているのが、SLM(Small Language Models:小規模言語モデル)です。SLMはモデルサイズが小さく推論が軽量なため、エッジ環境や自社GPU上での運用がしやすく、低遅延での応答を実現しやすい特長があります。クラウドを介さずに動かせることで、ネットワーク遅延やデータ取り扱いの制約を抑えつつ、業務システムへ自然に組み込みやすい点も、企業利用における大きな利点です。

一方で、クラウド提供型のLLMは、汎用性や表現力に優れる反面、APIコストやレイテンシ、機密データの扱いといった観点で、用途によっては運用上の制約となることもあります。本記事では、SLMの基本的な考え方とLLMとの違いを整理したうえで、代表的なSLMモデルの選び方、SLM運用に適したGPU構成、業界別の活用イメージ、そして導入を成功させるための検討ポイントを、企業のAI活用という実務目線で解説します。

GPU製品・サービス

AI/Iot、デジタルツイン用途に適したGPUサーバーを設計・構築。さらにデータセンター・ネットワークなど、GPU運用に必要なシステムをワンストップで提供可能。

SLM(小規模言語モデル)とは ― 特定用途に最適化された軽量AI

SLM(Small Language Models:小規模言語モデル)とは、LLM(大規模言語モデル)と比べてパラメータ数を抑えた軽量な言語モデルです。

LLMが数百億〜数兆規模のパラメータを持ち、幅広いタスクに対応する汎用型であるのに対し、SLMは数億〜数十億規模に設計を絞り込むことで、特定の業務やドメインに適した運用を行いやすくしたモデルと位置づけられます。

モデル規模を抑えることで、SLMは業務システムへの組み込みや、オンプレミス・エッジ環境での利用に適した特性を持ちます。即時性や安定性が求められる業務用途において、「軽く・速く・近くで動かせる」点が大きな強みです。

主な特徴は次のとおりです。

- モデルが小さい

数億〜数十億パラメータ規模で設計されることが一般的で、推論処理が軽量です。 - 必要なGPU・VRAMが少ない

大規模なGPUクラスタを前提とせず、ワークステーションやエッジデバイスでも動かしやすい設計です。 - 用途特化で実用精度を出しやすい

医療、金融、社内文書など、対象領域を絞って設計・調整することで、特定分野では高い実用精度を発揮します。

※ここでいう用途特化とは、必ずしも独自に学習を行うことを指すものではなく、既存モデルをベースに用途を限定したり、必要に応じて軽量な追加学習(LoRAなど)を行うケースも含みます。 - コストと運用負荷を抑えやすい

モデルサイズが小さいため、PoCから本番まで導入しやすく、運用コストや管理負荷も抑えやすい傾向があります。

このようにSLMは、「フル装備の汎用AI(LLM)をそのまま使う」のではなく、「業務に必要な機能に絞って軽量化して使う」という考え方に基づくアプローチです。

特定用途における実用性と運用のしやすさを重視する企業にとって、現実的で扱いやすい選択肢として注目されています。

LLMとSLMの違いを比較する ― コスト・遅延・セキュリティの視点から

LLMとSLMのどちらを選ぶべきかは、業務内容、求められる応答速度、データの取り扱い方、予算や運用体制によって大きく変わります。

特に企業利用では、「精度が高いかどうか」だけでなく、遅延・コスト・セキュリティを含めて業務に耐えるかという観点が重要になります。

ここでは、実務で判断しやすい主要な観点から両者の違いを整理します。

両者の違いを主要な観点で整理すると、次のようになります。

| 項目 | LLM(大規模言語モデル) | SLM(小規模言語モデル) |

|---|---|---|

| パラメータ数 | 数百億〜数兆 | 数億〜数十億 |

| 学習データの性質 | インターネット全体など広範なデータ | 特定分野・用途を意識したデータ構成 |

| 得意領域 | 汎用的な文章生成・推論・要約など | 特定業務・ドメインに特化した処理 |

| GPU構成の考え方 | 大規模GPUクラスタが前提(クラウド型の場合は提供側で管理) | 単一または少数GPUで設計・運用可能 |

| 推論速度 | ネットワーク往復や共有基盤の混雑の影響を受け、応答が変動しやすい | オンプレ/エッジで近くに配置でき、要件に合わせて低遅延を設計しやすい(※モデルサイズ、同時実行数、入出力長、実装で変動)。 |

| 運用環境 | クラウドもしくはオンプレミス | オンプレミス/エッジでも運用可能 |

| コスト構造 | クラウドLLMの場合APIの従量課金、オンプレミスの場合GPUコストが高額になりやすい | 初期・運用コストを抑えやすい傾向 |

クラウドLLMは「GPUを意識せずAPIとして使える」点が強みである一方、SLMは「GPU構成を自分たちで設計できる」ことで、遅延・コスト・データ配置を業務要件に合わせて最適化しやすい点が特徴です。

ここで、主なSLMのメリットを紹介します。

短期間での学習とカスタマイズによる現場フィット

LLMのような大規模モデルは、学習に必要なコスト・データ量・ハードウェア要件が大きくなりがちです。一方、SLMはモデルが小さく比較的シンプルなため、ファインチューニングやカスタマイズを短期間で行いやすいという強みがあります。自社の業務フローや専門用語に合わせて、現場に最適化したモデルをスピーディに作ることが可能です。また導入後も、運用しながら小さく改善を重ねる形で、現場のニーズに合わせて継続的にアップデートできます。

推論速度(レスポンス特性)

LLMはモデルが大きく、クラウド上で動かすことが前提になるため、推論が重く、ネットワーク越しの呼び出しで遅延が発生しやすい傾向があります。特に製造ラインのように「数秒以内の応答が必須」の現場では、クラウド待ち時間がライン停止リスクにつながりかねません。一方、SLMはモデルが小さく、オンプレやエッジ端末に直接載せられるため、ネットワーク待ち時間を減らしやすく、軽い計算で高速応答を狙えます。"すぐに結果が必要な場面"では、SLMのほうが現実的に運用しやすくなります。

機密情報も扱えるセキュリティ

LLMをクラウドで利用する場合、入力データを外部のサーバーに送る必要があります。医療・金融・製造のように機密性が高いデータを扱う現場では、「データを外に出すことが可能か」が大きな壁になります。

SLMはモデルサイズが小さく、オンプレ/閉域ネットワーク内にモデルを置いて動かせるため、データを社外に送らずにAI処理を完結できる場合があります。機密情報を外部に出せない現場でも、安全にAI処理を行えます。

明確なコスト構造

LLMのコスト構造は、クラウド型で使うか、オンプレミスで運用するかによって大きく異なります。クラウドLLM(API利用)の場合、コストはリクエスト数やトークン量に応じた従量課金が基本です。初期投資が不要で導入しやすい一方、問い合わせ対応や業務アプリへの組み込みなどで利用量が増えると、月額コストが利用状況に比例して増加しやすく、事前に上限を読みづらいという特徴があります。オンプレミスLLMの場合、自社で高性能GPUクラスタを用意し、大規模モデルを運用する必要があります。そのため、GPUサーバーの導入費用や電力・冷却・保守といったインフラコストが高額になりやすく、初期投資・運用負荷ともに大きい構成になりがちです。

一方、SLMを自社GPUで運用する場合は、モデル規模が小さいため、単一または少数GPUでの構成が可能です。初期にGPUサーバーの導入費用(購入またはリース)は発生しますが、従量課金ではないためコストは比較的安定しやすく、数年単位でTCO(総所有コスト)を見積もりやすいという利点があります。

代表的なSLMモデルとその特徴 ― 用途に応じた選び方

このように多くの、メリットがあるSLMですが近年さまざまな企業から軽量で高性能な SLM がオープンソース(OSS)で登場しています。

ここでは、代表的なモデルについて「どんな強みがあり、どんな用途に向いているか」を中心にご紹介します。

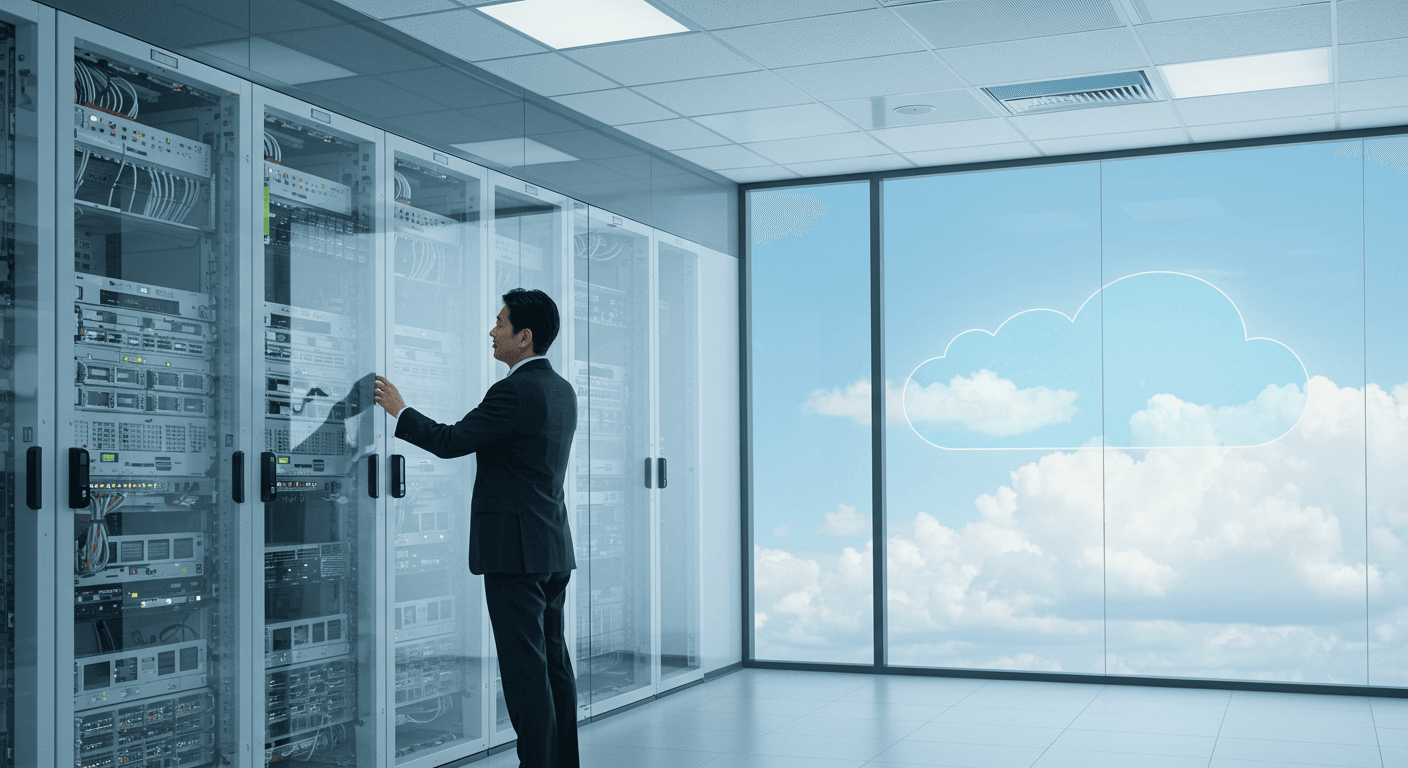

Microsoft — Phi シリーズ

MicrosoftのPhiは、小規模ながら高度な推論・論理・コーディング処理ができる SLM シリーズです。エッジデバイスやローカル実行にも対応する効率重視設計が特徴です。

Phiファミリイメージ(引用:Microsoft)

主なモデルと特徴

- Phi-4(約14B)

最新世代の代表モデルで、特に数学的推論やコード生成、論理的な文章処理に強い点が特徴です。 - Phi-4-mini(約3.8B)

サイズが小さい分、GPUリソースが限られた環境(エッジやオンプレ)でも扱いやすいのが特徴です。 - Phi-4-multimodal(約5.6B)

画像・音声・テキストをまとめて扱うためのモデルで、会話の流れを踏まえた自然な対話が可能です。

Google — Gemma シリーズ

Googleが提供するGemmaは、Geminiの技術を軽量版に応用したSLM 系列です。開発・運用しやすいサイズ展開の中で、多言語や(世代によって)マルチモーダルにも対応できるのが特徴です。

Gemmaイメージ(引用:Google)

主なモデルと特徴

- Gemma 3

用途に合わせて選べる1B / 4B / 12B / 27Bの複数サイズを提供する言語モデルで、多言語対応とマルチモーダル機能(※1B以外)が大きな強みです。 - Gemma 3n

スマホやノートPCなどの端末上で動くように設計されたAIモデルです。音声やカメラ映像をすばやく理解でき、オフラインでも使用可能です。

Meta — Llama シリーズ

MetaのLlamaは、本来大規模モデルが中心ですが、Llama 3系の小型・中型モデルは SLM としても広く活用されています。オープンソースで活発に派生モデルが出ています。

Llama 3.2イメージ(引用:Meta)

主なモデルと特徴

- Meta Llama 3.2

「軽量なテキスト専用モデル(1B/3B)」と「画像も扱えるビジョンモデル(11B/90B)」を同時に用意しているのが特徴です。特に 1B/3B は最大128Kトークンの長いコンテキストに対応しており、エッジやモバイルなどの限られた環境でも使いやすい設計になっています。

Mistral AI — Mistral シリーズ

フランス発の Mistral AIは、軽量性と実務性能のバランスを重視した言語モデルです。軽量モデルでも指示フォロー能力・多言語性能が高い点が特徴です。

Mistral 3イメージ(引用:Mistral AI)

主なモデルと特徴

- Ministral 3

3B/8B/14B と幅があり、軽く多様な生成タスクに対応しています。ローカル運用やエッジ用途を強く意識した軽量 SLM シリーズです。 - Mistral NeMo

Mistral AI が NVIDIAと共同開発した12Bパラメータの小規模言語モデルです。最大128Kトークンの長文コンテキストに対応している点が大きな特徴です。

モデルの選定基準

SLMは、どの環境で・何を入力して・どれだけの推論力が必要かによって、選ぶべきモデルが変わります。

ここでは、実務でよくある利用パターンごとに、モデル選定の考え方を整理します。

軽量、ローカル/エッジで回したい(テキスト中心)

エッジ端末やオンプレミス環境では、VRAM容量・消費電力・レイテンシに制約があるため、まずは小型で扱いやすいテキスト特化モデルが第一候補になります。

問い合わせ分類、簡易要約、ルール補助など、即時性を重視する用途に向いています。

推論・数学・コード生成をしっかりやりたい(精度優先)

数式処理や論理推論、コード生成など、誤りが業務影響につながる領域では、モデルサイズをある程度確保し、推論性能を優先した方が安定します。単一GPU構成でも運用可能な範囲で、バランスの良いモデルを選ぶのが現実的です。

画像や音声も扱いたい(マルチモーダル)

画像内テキストのOCR、表・グラフの読み取り、音声の文字起こしや要約などを行う場合は、マルチモーダル対応モデルであることが前提になります。

テキスト専用モデルでは対応できないため、用途を明確にしたうえで選定する必要があります。

代表例

- Phi-4-multimodal

- Gemma 3(4B以上)

スマートフォン/ノートPCで「オフライン前提」で動かしたい(低遅延)

ネットワーク接続が不安定な現場や、個人情報・機密情報の観点からクラウド送信を避けたい場合は、オンデバイス実行を最優先で考えます。

モデルサイズと省電力性を重視し、レスポンスの速さを確保する設計が重要です。

SLM導入を成功させるための検討ポイント

SLMは比較的導入しやすい技術ではありますが、効果を最大化するには事前の計画と準備が欠かせません。特に、自社環境でAIを初めて本格運用する企業にとっては、従来の業務システム導入とは異なる観点での検討が必要になります。

導入後に「思ったより精度が出ない」「想定以上に運用が大変だった」といった問題に直面しないためには、技術面と組織・運用面の両方から段階的に備えることが重要です。

用途の明確化とモデル選定

SLM導入においてまず重要なのは、どの業務プロセスに適用するのかを明確にすることです。文書分類、情報抽出、質問応答、要約支援など、用途によって求められるモデルの特性は異なるため、目的に合ったモデルを選定する必要があります。

PoC(概念検証)の段階では、いきなり高性能・大規模なモデルを前提にするのではなく、比較的小さなモデルから効果を検証することが現実的です。精度や応答速度、運用時の負荷を確認しながら段階的にスケールさせていくことで、導入リスクを抑えつつ、自社業務に適したモデル構成を見極めやすくなります。

GPU環境の準備

SLMを業務で安定的に運用するためには、用途に応じたGPU環境を整えることが重要です。モデルサイズが比較的小さいとはいえ、GPU構成を誤ると、応答遅延や同時利用時の性能低下といった問題が発生しやすくなります。

GPU環境を設計する際は、あらかじめ次の観点を整理しておくと判断しやすくなります。

- 使用するモデルのサイズと精度(通常/量子化)

- 想定する入力の長さ(短文中心か、長文か)

- 同時に処理するユーザー数・リクエスト数

- オンプレミス/エッジなど、設置環境の制約

また、GPU環境を検討する際は、計算性能よりも先に、VRAM容量に着目することがポイントになります。

VRAM容量の考え方

VRAM(ビデオメモリ)は、GPUがモデルや推論中のデータを保持するための専用メモリです。SLM運用では、このVRAM容量が扱えるモデルサイズや、入力の長さ、同時利用数の上限を事実上決める要素になります。

VRAMが不足すると、次のような問題が起きやすくなります。

- モデルをGPUに載せられない

- 長文入力時に急激に遅くなる

- 同時アクセスが増えた際に処理が詰まる

そのためGPU選定では、「演算性能が高いかどうか」よりも、用途に対して十分なVRAMに余裕があるかを基準に考えることが重要です。

セキュリティとコンプライアンス

SLMを業務で利用する場合、アクセス制御やログ管理、データの暗号化といった基本的なセキュリティ要件を満たすことは前提になります。加えて、学習データや推論結果に個人情報・機密情報が含まれる場合には、データの生成から保存、利用、廃棄までを含めた「データライフサイクル全体」でのセキュリティ設計が求められます。特にSLMは、オンプレミスやエッジ環境に配置されるケースが多く、「どこでデータを扱い、どこまでを外部に出さないか」を自社で明確に設計できる反面、その責任も自社側にあります。

そのため、次のような観点を事前に整理しておくことが重要です。

- 誰がモデル・推論結果にアクセスできるのか(権限管理・認証)

- 入力データや出力結果をどこに保存するのか、保存期間はどうするか

- ログをどの粒度で残し、監査やトラブル対応にどう活用するか

- モデル更新時や廃棄時に、データをどう扱うか

これらを含めて設計することで、セキュリティとコンプライアンスを両立したSLM運用が実現しやすくなります。

運用体制の構築

SLMを安定的かつ継続的に活用するためには、AI特有の運用業務に対応できる体制をあらかじめ整えておくことが重要です。モデルの性能監視や定期的な調整、システムの保守・更新といった作業を、属人的にせず回せる体制を構築することで、運用負荷の増大や品質低下を防ぎやすくなります。

具体的には、次のような役割を意識しておくと整理しやすくなります。

- モデルの精度や応答品質を定期的に確認する役割

- 利用状況や業務要件の変化に応じて、ファインチューニングや設定見直しを行う役割

- GPUや実行環境を含めたシステム全体の保守・更新を担う役割

すべてを専任である必要はなく、「誰がどこまでを見るのか」を明確にしておくことが、SLMを業務に根付かせるうえでのポイントになるでしょう。

まとめ

本記事では、SLMの基礎から、LLMとの違い、実務におけるメリット、代表的なモデルの選び方、GPU環境の考え方、そして導入を成功させるための検討ポイントまで、企業の現場でAIを活用するうえで必要となる視点を整理してきました。LLMは、その圧倒的な汎用性と表現力が大きな魅力である一方、実際に業務システムへ組み込む段階では、コストの増大、推論遅延による業務影響、機密データを外部に送信できない環境での制約、そしてモデル規模が現場要件に合わないといった課題が顕在化しやすくなります。

これに対してSLMは、用途を絞った軽量設計により、必要な性能を小さな計算資源で実現できる点が大きな強みです。オンプレミスやエッジ環境で運用しやすく、コストの最適化、低遅延な処理、データを外部に出さないセキュアな運用、さらには業務に合わせた短期間でのモデル改善など、実務で求められる条件を満たしやすい特性を備えています。

また、SLM運用の成否を左右する重要な要素がGPU構成です。モデルサイズや入力条件、同時利用数を踏まえて必要なVRAMを見極めることで、過剰投資を避けながら、安定した運用環境を構築することが可能になります。

GPU製品・サービス

AI/Iot、デジタルツイン用途に適したGPUサーバーを設計・構築。さらにデータセンター・ネットワークなど、GPU運用に必要なシステムをワンストップで提供可能。

※Microsoftは、米国Microsoft Corporationの米国およびその他の国における登録商標です。

※Googleは、Google LLC の登録商標または商標です。

※NVIDIAは、米国およびその他の国におけるNVIDIA Corporationの商標または登録商標です。

※本記事は2026年2月時点の情報に基づいています。サービス/製品に関わる情報等は予告なく変更される場合がありますので、あらかじめご了承ください。サービス提供事業者が公表している最新の情報が優先されます。