文字認識×翻訳×画像編集で実現するマンガ自動翻訳~GPUクラスタとフルスタックエンジニアリングが支えるAI翻訳技術でエンターテインメントから言語の壁をなくす~

Mantra株式会社

Mantra株式会社

【取り組みの背景】

- マンガ翻訳に特化したAIモデルの研究開発を推進

- 生成AIの進化に伴いモデルが大型化し、より高性能なGPU環境が必要に

- 事業・組織の拡大により、研究開発専用のGPUリソースを確保する必要性が高まった

【取り組みの成果】

- ハイエンドなGPUクラスタ基盤の導入により、画像編集モデルの推論速度が5~10倍に向上(吹き出し1個あたり50秒→5~10秒)

- 研究開発専用のGPU環境を確保し、リサーチャーが十分にリソースを活用できる体制を構築

- 大規模モデルの実行が可能になり、従来動かなかったモデルが稼働

- RAIDストライピングおよび分散高速ストレージの導入により、大規模データセットの読み書き高速化と高可用性・拡張性を両立

- 外部APIサービスでは実現できない、マンガに特化した独自の画像生成手法の確立に貢献

「正確に翻訳する」だけでは足りない。大切なのは「楽しさと世界観を翻訳する」こと──。Mantra株式会社は、「エンターテインメントから言語の壁をなくす」というビジョンのもと、マンガ翻訳に特化したAI技術を開発するスタートアップだ。大手出版社と連携し、週刊連載作品の多言語同時配信を支える技術を提供している。従来4~7日かかっていた翻訳作業を最短2日に短縮し、読者が待たずに正規版でマンガを楽しめる環境を実現している。

その技術の核となるのが、文字認識、翻訳、画像編集を組み合わせたマンガ翻訳プラットフォームであるMantra Engineだ。吹き出しの翻訳だけでなく、背景に直接描かれた文字の消去・補完まで一貫して自動で処理を行う。特に、背景文字の消去・補完を行う画像編集の部分で高性能なGPUが必要となる。しかし、生成AIの進化に伴いモデルの大型化が進み、従来のGPU環境では処理速度やメモリ容量が追いつかなくなっていた。2025年、同社は研究開発専用の高性能GPUクラスタ&ストレージ基盤を導入。推論速度は5~10倍に向上し、研究開発サイクルが劇的に加速した。

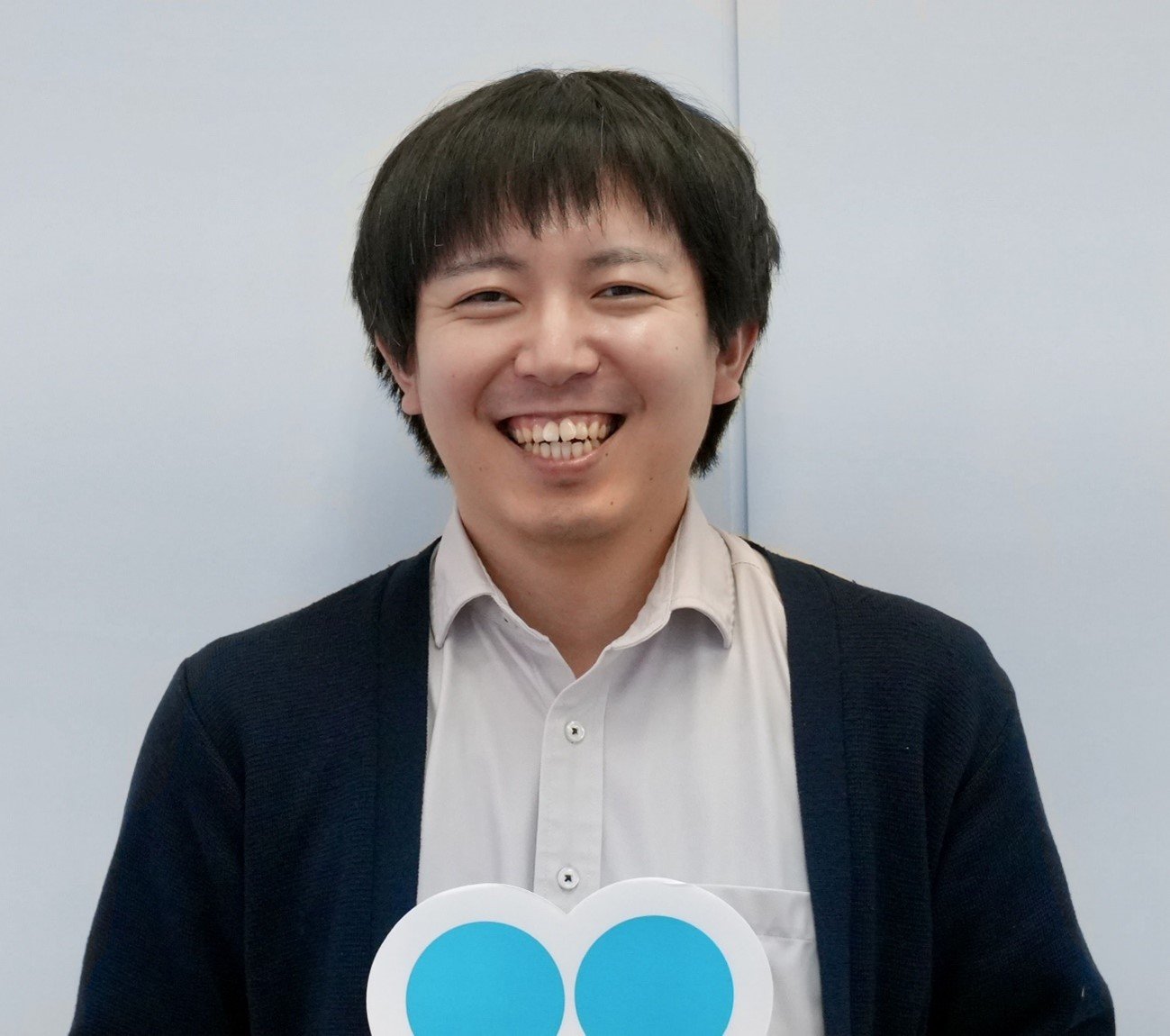

本記事では、最高技術責任者の日並氏、リサーチャーの古田氏、リサーチエンジニアの幾田氏の3名に、GPU導入の経緯、独自技術、そして同社で働く魅力について伺った。

エンターテインメントから言語の壁をなくす──Mantraが目指す世界

──まず、Mantraのビジョンと事業について教えてください。

日並氏「弊社は『エンターテインメントから言語の壁をなくす』というビジョンを掲げるスタートアップです。事業としては、マンガをはじめとするエンターテインメント翻訳事業とマンガを使って言語を学習するモバイルアプリLangakuの2つを展開しています。エンターテインメント翻訳事業の基盤となるのが、マンガ翻訳プラットフォーム「Mantra Engine」です。マンガ特化のAI技術で翻訳ワークフロー全体を効率化し、現在20言語に対応しています。」

──このビジョンに至った背景を教えてください。

日並氏「代表の石渡と私は大学の博士課程で同期で、代表は自然言語処理、私は画像系の研究をしていました。研究室には留学生が多く、マンガの話題でよく盛り上がっていたんです。ただ、みんな非公式翻訳で読んでいたんですね。

なぜ非公式翻訳が使われるのか調べてみると、翻訳にコストと時間がかかるため、正規版の配信が遅れてしまうこと、そしてそもそも公式に翻訳されていない作品が多いことが原因でした。技術で翻訳のハードルを極限まで下げることができれば、どんな作品も一瞬で世界中に届けられる──そんな世界を実現したいと思ったんです。言語と画像を組み合わせた翻訳は技術的にもかなり難しい領域でした。その挑戦しがいのある面白さと、解くべき課題の大きさ、そして実現したときに世界に届けられる価値に惹かれ、この事業を始めました。」

──正規版の翻訳を世界に届けるには、出版社との連携が不可欠だと思います。どのような体制で取り組まれているのですか?

日並氏「大手出版社とは密に連携しており、一部の出版社からは出資もいただいています。基本的には、出版社が海外にマンガを出したいというニーズに対して、弊社が翻訳工程を担う形です。例えば、出版社が運営する海外向けマンガプラットフォームでは、最新作の日本語版と多言語版の同時配信が行われていますが、その翻訳を弊社のエンジンで行い、社内の翻訳チームがプロの視点で仕上げることで、短納期での多言語展開を実現しています。」

マンガに特化した独自のAI技術──『楽しさ』と『世界観』を表現する翻訳技術

同社のビジョンを実現する技術の核が、Mantra Engineだ。単なる文字の翻訳だけでなく、画像編集を含む一連のフローを効率化している。その技術的な仕組みと、エンターテインメント翻訳ならではの難しさについて伺った。

文字認識から画像編集まで──複数のAI技術を組み合わせた翻訳フロー

──Mantra Engineの技術的な仕組みを教えてください。

日並氏「Mantra Engineでは、元の画像から文字を認識し、それを翻訳し、画像上の日本語を消して背景を補完し、翻訳したテキストを適切にレイアウトして配置する、という一連のフローがすべて自動で処理されます。文字認識、翻訳、画像編集、レイアウトは、それぞれ別のAIモデルを使い、それぞれをマンガに特化させています。」

古田氏「背景に書かれた文字も処理できるのがMantra Engineの強みです。日本語の文字を消して背景を補完する必要があるのですが、この画像編集が特に高性能なGPUが必要な処理の一つです。」

「楽しさと世界観」を翻訳する──エンターテインメント翻訳の難しさ

──翻訳なら既存のサービスもあると思いますが、マンガ翻訳ならではの難しさはあるのでしょうか?

日並氏「マニュアルなどの実用文書の翻訳なら、意味が正確に伝わればいい。でも、マンガやエンターテインメントの翻訳では『読んで楽しいこと、そして原作の世界観を忠実に表現すること』が大切です。同じ『翻訳』でも、やっていることはかなり別物だと感じています。キャラクターごとに一人称や語尾を訳し分けたり、シーンに応じて喋り方のトーンを変えたり、作品全体を通して用語を一貫させたりする必要があります。日本語は主語がなかったり、敬語の概念があったり、英語に直訳できない表現が多い。そこをうまく『楽しく』翻訳するのが、マンガ翻訳の難しさであり、面白さです。」

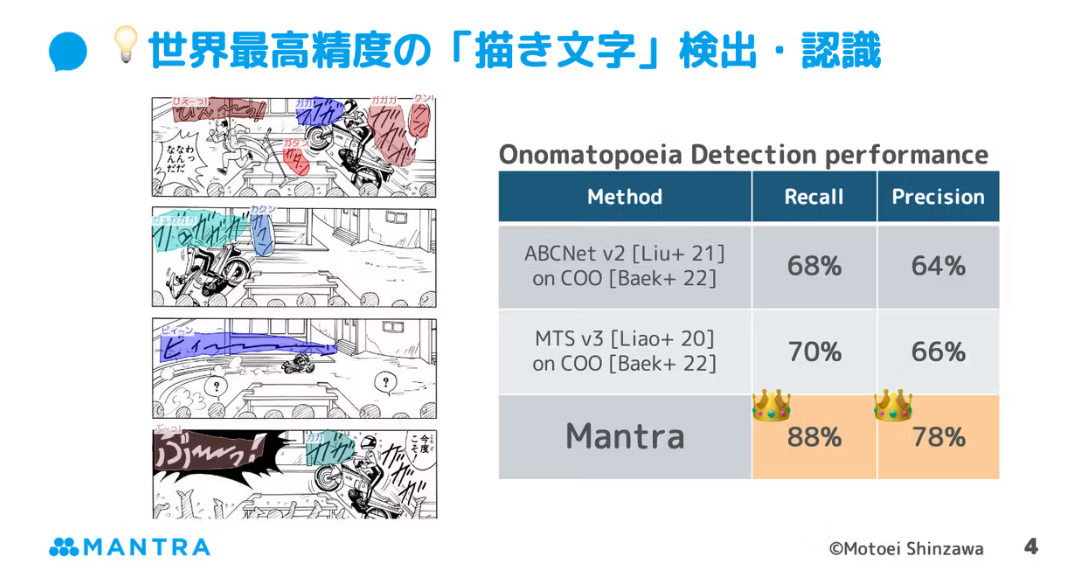

幾田氏「ビジュアル面の翻訳も重要です。例えば『ドン』というような擬音だと力強いフォントで表現することで、インパクトが生まれます。このビジュアル面の翻訳も、NEDO※1の事業で研究開発を進めてきました。」

Mantraのマンガ翻訳を支える技術:「描き文字」検出・認識(引用:Mantra株式会社ページより抜粋)

※1 NEDO:国立研究開発法人新エネルギー・産業技術総合開発機構

従来ワークフローの課題を一元化──50~70%の時短効果

──Mantra Engineを利用しない従来のマンガ翻訳のワークフローと比べて、どのような改善があったのでしょうか?

日並氏「従来のマンガ翻訳は非常に複雑なワークフローでした。日本語の文字を書き起こしてExcelに落とし、翻訳者に渡してExcel上で翻訳してもらう。それをデザイナーに渡し、画像編集ツールで日本語の文字を消し、翻訳したテキストを配置する。最後に全体を監修してチェックする。翻訳者、校閲者、デザイナー、監修者と、複数の専門家が必要で、複数のツールを使い分ける必要がありました。

Mantra Engineでは、すべての工程がブラウザ上で完結します。翻訳・画像編集・レビューが同じエディタ上で完結するので、担当者同士もその画面上でコメントや修正をやり取りできます。従来のようにツールをまたいで受け渡す工程そのものがなくなるので、納期も大幅に短縮できます。」

幾田氏「マンガ一話あたりの翻訳と文字消去作業に通常4~7日かかっていた時間を、最短2日程度に仕上げられるようになりました。概ね50~70%程度の削減効果が表れています。納期が非常にタイトな週刊連載の多言語同時配信では、この短縮の意義が特に大きいです。」

GPU導入の背景──モデル大型化と研究開発環境の限界

Mantra Engineの開発を支える技術基盤が、ハイエンドなGPUクラスター&ストレージ基盤だ。生成AIの進化に伴いモデルが大型化する中、従来のGPU環境では限界が見え始めていた。

生成AIの進化とモデルの大型化

──GPU導入の背景を教えてください。

日並氏「以前のGPUサーバーは5年ほど前のもので、当時としては十分なスペックでしたが、生成AIの進化に伴いモデルが大型化し、メモリ容量や処理速度が追いつかなくなってきました。また、当時のGPUサーバーは研究開発と製品サービスで共用していたため、リサーチャーが十分にGPUを使えない状況で、事業と組織の拡大に伴い研究開発専用のGPU環境が必要になっていました。」

古田氏「研究に使いたいのにGPUが空いていないこともありました。『もっとGPUが欲しい』という要望は以前から出していましたね。」

マンガに特化した独自の技術アプローチ

──外部の画像生成APIサービスを使うという選択肢もあったと思いますが、自社でモデルを持つ理由を教えてください。

幾田氏「外部サービスで画像を投げると編集されたものが返ってくるAPIもあります。ただ、外部サービスでは細かいチューニングや指示が困難で、生成AIを使った痕跡が残ったり、不十分な状態で返ってくることが多く実際に使えないことが多くあります。そのため、大きなモデルであっても自社でチューニングを加えて、生成過程を変更しています。」

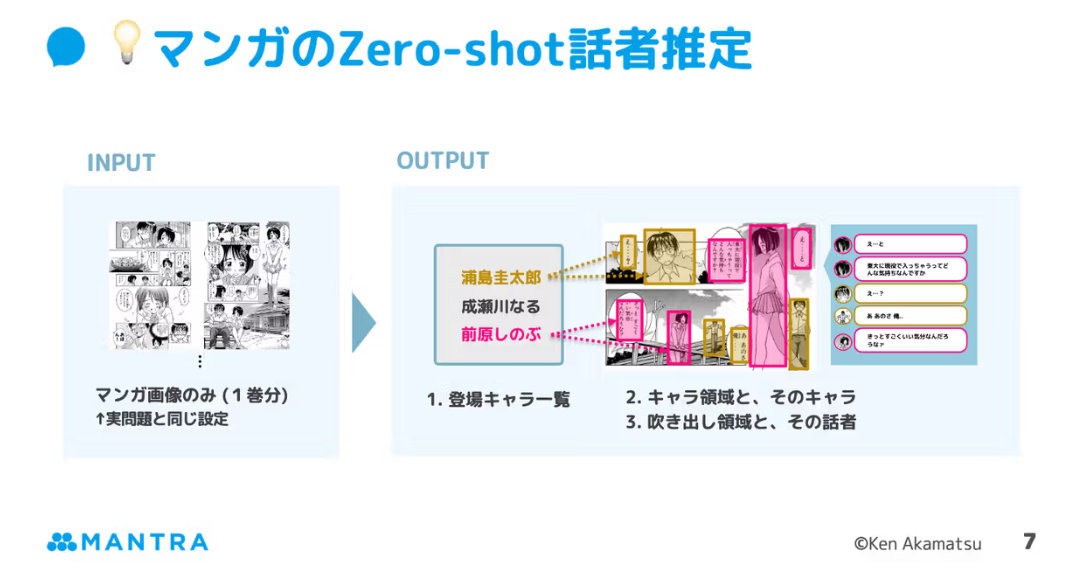

Mantraのマンガ翻訳を支える技術:Zero-shot話者推定(引用:Mantra株式会社ページより抜粋)

マンガの背景補完では、作家ごとの絵柄やタッチ、線の太さ、トーンの使い方など、作品固有の表現を尊重しながら処理する必要がある。外部APIでは、こうした細かな制御ができず、出版社が求める品質基準を満たすことが難しい。自社でモデルを保有し、生成プロセスの細部までコントロールできる環境が、Mantra Engineの品質を支えている。

──技術的な話になりますが、どのようなアプローチを取られているのですか?

古田氏「既存の画像生成技術をマンガに最適化する独自の手法を開発しています。著作権のあるデータの扱いにも配慮しながら、マンガ特有の表現に対応できるよう工夫しています。」

幾田氏「だからこそ、自社でモデルを持つ必要があり、そのためには高性能なGPUが必要です。外部サービスでは実現できない、マンガに特化したカスタマイズを行っています。」

──この技術は公開されているのですか?

古田氏「手法そのものの詳細は公開していませんが、関連する技術については今後学会で発信していく予定です。」

NTTPCを選んだ理由──GPUだけじゃない、「フルスタックエンジニアリング」による技術要件への対応と補助金サポート

──NTTPCを選ばれた理由を教えてください。

日並氏「AIスタートアップのGPUクラスタ構築事例をプレスリリースで拝見し、知りました。GPU性能をフルに活かすためには、ストレージやネットワーク周りの要件が非常に重要です。特に、画像を使った学習ではディスクアクセス※2がボトルネックになりやすいため、ストレージをオールフラッシュ※3にしたいと考えていました。加えて、可用性や拡張性の観点からもストレージ構成にはいくつか要件があり、こうした総合的な要件に対応できるベンダーは限られていました。NTTPCは、技術要件を理解した上で、柔軟な構成を提案してくださいました。

複数社に相見積もりを取りましたが、NTTPCが価格面でも優位でした。正直、最初は高いイメージがあったのですが、実際には良心的な価格と信頼できるサポートで驚きました。」

※2ディスクアクセス:学習に使う画像データを、ストレージ(SSD/HDD)から読み出したり、途中結果やデータを書き込んだりする処理

※3 オールフラッシュ:すべてのストレージをSSD(Solid State Drive)などのフラッシュメモリで構成すること。従来のHDDと比べて読み書き速度が大幅に速い

──ストレージ構成についても工夫されたと伺いました。

幾田氏「今回の導入では、ストレージ構成にも工夫をしました。当初は各サーバーに4TBのRAID※4構成で内蔵ストレージを付ける予定でしたが、NTTPCの岡本さんと相談して、RAIDストライピング構成に変更しました。4TB×3で12TBのストレージを各サーバーに付けられるようにしました。

機械学習では大容量のデータを高速に読み書きする必要があります。実際、11TB程度のデータセットがあり、これが乗らないと厳しい状況でした。RAIDストライピングによって、大容量かつ高速なストレージ環境を実現できました。

また、データの一次処理は各サーバーの内蔵ストレージで行いますが、各GPUサーバー共通で利用できるストレージプールや高可用性・拡張性の確保の観点から、外部ストレージの構築も検討していました。そこでNTTPCにて、要件を叶えるスケールアウト型の分散ストレージソリューションと、高速Ethernetによる各GPUサーバーとの接続構成案を設計、ご提案いただき導入を決めました。

ファイアウォールを含むセキュリティ構成も非常に勉強になりました。教科書のような綺麗な構成で、その後の弊社のインフラ周りやセキュリティ仕様の策定にも、この経験が活きています。」

※4 RAID:Redundant Array of Independent Disksの略。複数のディスクを組み合わせて利用する技術。RAID 0はデータを複数のディスクに分散して書き込むことで高速化を図る構成で、冗長性はない一方、複数ディスクの容量を合計して使える。

──補助金の活用についても伺えますか?

日並氏「NEDOのDTSU※5(ディープテック・スタートアップ支援事業)の補助金を活用し、3分の2が助成対象となりました。これがなければ全額は厳しく、もう少し規模を小さくする必要があったかもしれません。補助金申請では、システムの構成や設計の情報をまとめる必要がありました。NTTPCは、本来であれば発注後の設計フェーズで行うことを、受注前の段階から相談に乗ってくださいました。DTSU申請時の概算見積もりから、支援決定後のRFP作成、複数社とのコンペを経て発注決定するまで1年ほどかかったものの、しっかりとご対応いただきました。」

※5 DTSU:Deep Tech Startup支援事業。革新的な技術を持つスタートアップ企業の研究開発を支援するNEDOの補助金制度

※6 RFP:Request for Proposalの略。提案依頼書

GPU製品・サービス

AI/Iot、デジタルツイン用途に適したGPUサーバーを設計・構築。さらにデータセンター・ネットワークなど、GPU運用に必要なシステムをワンストップで提供可能。

導入効果──推論速度が5~10倍に向上、Mantra Engineにより翻訳・文字消去工程は50~70%削減

ハイエンドなGPUクラスタ&ストレージ基盤の導入により、同社の研究開発環境は大きく変わった。推論速度は5~10倍に向上し、研究開発サイクルが劇的に加速している。具体的にどのような効果が得られたのか。

推論速度が5~10倍に向上

──GPU導入による具体的な効果を教えてください。

幾田氏「具体的な数値で言うと、以前のGPUで古田が開発した画像編集モデルを動かすと、吹き出し1個の処理に50秒程度かかっていました。新しいサーバーでは5~10秒なので、およそ5~10倍の高速化です。研究開発では何度も実験を繰り返す必要があるので、この高速化は非常に重要です。研究開発サイクルが劇的に短縮されました。」

古田氏「以前は製品向けと共用だったので、空いている部分を研究開発に使う形でした。今回は専有リソースとして確保できたので、研究開発に集中できるようになりました。」

翻訳・文字消去作業時間50~70%削減を支える、研究開発基盤の強化

先述したとおり、Mantra Engineの活用により、マンガ一話あたりの翻訳と文字消去作業は従来4~7日かかっていたものが最短2日程度まで短縮され、50~70%程度の削減効果が表れている。

特に週刊連載作品のように短い納期での対応が求められる現場では、この改善の意義は大きい。

今回のGPU導入は、こうした仕組みを支える研究開発環境の強化に貢献しており、モデル改善や検証のサイクルをより速く回せるようになった点に意義がある。

GPU製品・サービス

AI/Iot、デジタルツイン用途に適したGPUサーバーを設計・構築。さらにデータセンター・ネットワークなど、GPU運用に必要なシステムをワンストップで提供可能。

研究畑出身者が集うグローバルなチーム

高度な技術を支えるのは、高い専門性を持ったエンジニア・リサーチャーたちだ。同社では、東京大学出身者や博士課程修了者をはじめとしたメンバーが研究開発に取り組んでいる。会社全体でも、約20カ国から多才な人材が集まっている。同社で働く魅力について伺った。

3名全員が東京大学出身の博士

──今日お話しを伺った3名の皆さんについて、あらためて教えてください。

古田氏「もともと、日並、代表の石渡、私の3人は東京大学の学部から同期でした。創業時に誘われていたのですが、当時私はアカデミックの方面に興味があったので、いったん断って別々の道を進みました。その後、企業側の研究にも興味を持つようになり、合流しました。アカデミックとは違う、実際の課題解決に直結する研究開発の面白さがあると感じています。」

幾田氏「私はリサーチエンジニアとして、研究とプロダクトの橋渡しをしています。また、インフラやセキュリティも担当していて、研究者が業務に集中して最高効率を出せるような技術的基盤を構築することを、自分のミッションにしています。」

38%が外国籍、英語が公用語のグローバル環境

──チームの構成について教えてください。

日並氏「Mantraは非常にグローバルな環境です。社員の約38%が外国籍で、約20カ国から人材が集まっています。社内のコミュニケーションは基本的に英語で、ミーティングも英語で行われています。」

幾田氏「マンガを世界に届けるという事業の性質上、多様なバックグラウンドを持つメンバーが集まっていることは、大きな強みになっています。」

日並氏「Mantraでは、研究とプロダクトの両方に取り組める環境があります。新しい技術を研究するだけでなく、その技術が実際のサービスで使われ、世界中のユーザーに届く。そのやりがいは大きいと思います。エンジニア・リサーチャーを積極的に採用していますので、世界にインパクトを与える技術に挑戦したい方をお待ちしています。」

インタビューを通じて印象的だったのは、3名の技術者の掛け合いと、チーム全体の雰囲気の良さだ。取材中も笑い声が絶えず、難しい技術課題に取り組みながらも、互いに刺激し合いながら楽しんでいる様子が伝わってきた。

今後の展望

──ハイエンドなGPUクラスタ&ストレージ基盤の導入により研究開発基盤が整った同社。最後に、今後の展望について伺った。

日並氏「今回のGPU導入で、研究開発のスピードが大幅に向上しました。今後は、さらに精度を高め、より多くの作品、より多くの言語に広げていきたいと考えています。技術で言語の壁をなくすことで、どんな作品も一瞬で世界中に届けられる。そんな世界を実現したいと思っています。」

日本のマンガは、世界中で愛されるエンターテインメントコンテンツだ。しかし、言語の壁により、その魅力が十分に届いていない現実がある。高性能GPUの導入により研究開発のスピードはさらに加速し、多言語同時配信を支える技術は、世界中の読者が正規版で同時にエンターテインメントを楽しめる世界を実現しつつある。同社の技術は、日本のマンガ文化を世界に繋ぐ架け橋となっている。

GPU製品・サービス

AI/Iot、デジタルツイン用途に適したGPUサーバーを設計・構築。さらにデータセンター・ネットワークなど、GPU運用に必要なシステムをワンストップで提供可能。